DeepSeek R2 sigue siendo, a 7 de mayo de 2026, un modelo no anunciado públicamente por DeepSeek. Aun así, su posible llegada importa porque DeepSeek ya ha renovado su pila de razonamiento con R1, V3.2 y, más recientemente, V4, así que cualquier “R2” tendría sentido solo si aporta una mejora clara en razonamiento, coste o uso con agentes frente a lo que ya existe hoy [1][2][3].

Resumen rápido

- No hay un lanzamiento oficial de DeepSeek R2 confirmado en fuentes primarias de DeepSeek a fecha de 7 de mayo de 2026 [1][4].

- El modelo de razonamiento abierto confirmado por DeepSeek es DeepSeek R1, publicado con licencia MIT y con acceso por API y pesos abiertos [5].

- En la práctica, el salto relevante desde R1 no se llama R2 hoy, sino DeepSeek V4, disponible en

deepseek-v4-flashydeepseek-v4-pro, con 1M de tokens de contexto y hasta 384K de salida [2][6]. - Los alias

deepseek-chatydeepseek-reasonerse retirarán el 24 de julio de 2026; durante esta transición apuntan al modo sin razonamiento y al modo con razonamiento de V4 Flash, respectivamente [1][3]. - Si hoy buscas “el sucesor de R1”, la referencia útil no es una ficha de R2, sino comparar R1, V3.2 y V4 según coste, contexto, modo de razonamiento y uso real en API [1][2][5].

- Si DeepSeek acaba usando el nombre R2, lo razonable es esperar un modelo centrado en razonamiento y agentes, no solo una revisión menor. Eso es una inferencia editorial, no un anuncio oficial [2][4].

Qué se sabe de DeepSeek R2 hoy

La respuesta corta es simple: no existe, en las fuentes públicas verificables de DeepSeek, un anuncio oficial de DeepSeek R2. Ni la web de documentación, ni el registro de cambios de la API, ni el GitHub oficial muestran una entrada de lanzamiento, una ficha técnica o un repositorio con ese nombre a fecha de 7 de mayo de 2026 [1][4][7].

Eso no significa que el interés por deepseek r2 sea infundado. Desde el lanzamiento de DeepSeek-R1, el mercado espera una segunda generación explícita de razonamiento. Además, DeepSeek ha seguido actualizando su oferta con variantes como DeepSeek-R1-0528, con mejoras reportadas en AIME 2025, GPQA, LCB_v6 y Aider, y después ha desplazado gran parte del foco de producto hacia DeepSeek V4 [4][5].

Por tanto, hoy hay que separar dos cosas. Una es la especulación sobre un eventual “R2”. La otra es el estado real del catálogo. Ese catálogo sí está claro: R1 existe, V3.2 existe y V4 ya está publicado y disponible en la API oficial [1][2][5]. Si tu objetivo es elegir modelo o anticipar una migración, conviene basarte en ese mapa y no en rumores.

Si quieres revisar el estado actual de la plataforma, la referencia más útil es la página de precios, la documentación de la API y el acceso directo al chat de DeepSeek. Para contexto general de producto, también ayuda la portada de deepseek-espanol.chat.

Por qué la conversación ya no gira solo en torno a R1

La novedad de fondo en mayo de 2026 no es un hipotético R2, sino la llegada de DeepSeek V4 Preview. DeepSeek presentó V4 el 24 de abril de 2026 como una familia abierta con dos variantes: DeepSeek-V4-Pro y DeepSeek-V4-Flash. Ambas admiten 1M de tokens de contexto, ofrecen modos con y sin razonamiento y están disponibles en la API oficial el mismo día del anuncio [1][2][6].

Ese cambio altera la forma de leer la hoja de ruta. Antes era lógico pensar en una secuencia lineal “R1 → R2”. Ahora DeepSeek parece organizar su catálogo en torno a una familia generalista con modos de razonamiento integrados. La documentación oficial indica que V4 Flash soporta modo sin razonamiento y modo con razonamiento por defecto, mientras que los alias heredados se mantienen solo por compatibilidad temporal [1][3][6].

También cambia la expectativa sobre capacidades. DeepSeek describe V4 Pro como líder entre modelos abiertos en razonamiento matemático, STEM y código, además de destacar mejoras en tareas de agentes y programación autónoma. V4 Flash, por su parte, se posiciona como la opción rápida y económica, con un rendimiento cercano a V4 Pro en razonamiento y paridad en tareas agentivas simples [2].

En otras palabras, si mañana DeepSeek anunciara DeepSeek R2, tendría que justificar por qué existe como familia separada frente a V4. Esa lectura es una inferencia basada en la estrategia pública actual del catálogo [1][2].

Comparación práctica: R1, V3.2 y V4

| Modelo | Estado público | Contexto | Salida máxima | Razonamiento | Precio de entrada | Precio de salida |

|---|---|---|---|---|---|---|

| DeepSeek-R1 | Lanzado | No aplica aquí como referencia principal de la API actual | No aplica | Sí, enfocado en razonamiento | Históricamente por alias/API; hoy ya no es la referencia principal | No aplica |

| DeepSeek-V3.2 | Legado en API | 128K | 8K en chat / 64K en reasoner | Sí, según alias | $0,28 con fallo de caché / $0,028 con acierto de caché por 1M | $0,42 por 1M |

| DeepSeek-V4-Flash | Actual | 1M | 384K | Sí, modo con razonamiento y sin razonamiento | $0,14 con fallo de caché / $0,028 con acierto de caché por 1M | $0,28 por 1M |

| DeepSeek-V4-Pro | Actual | 1M | 384K | Sí, modo con razonamiento y sin razonamiento | $1,74 con fallo de caché / $0,145 con acierto de caché por 1M | $3,48 por 1M |

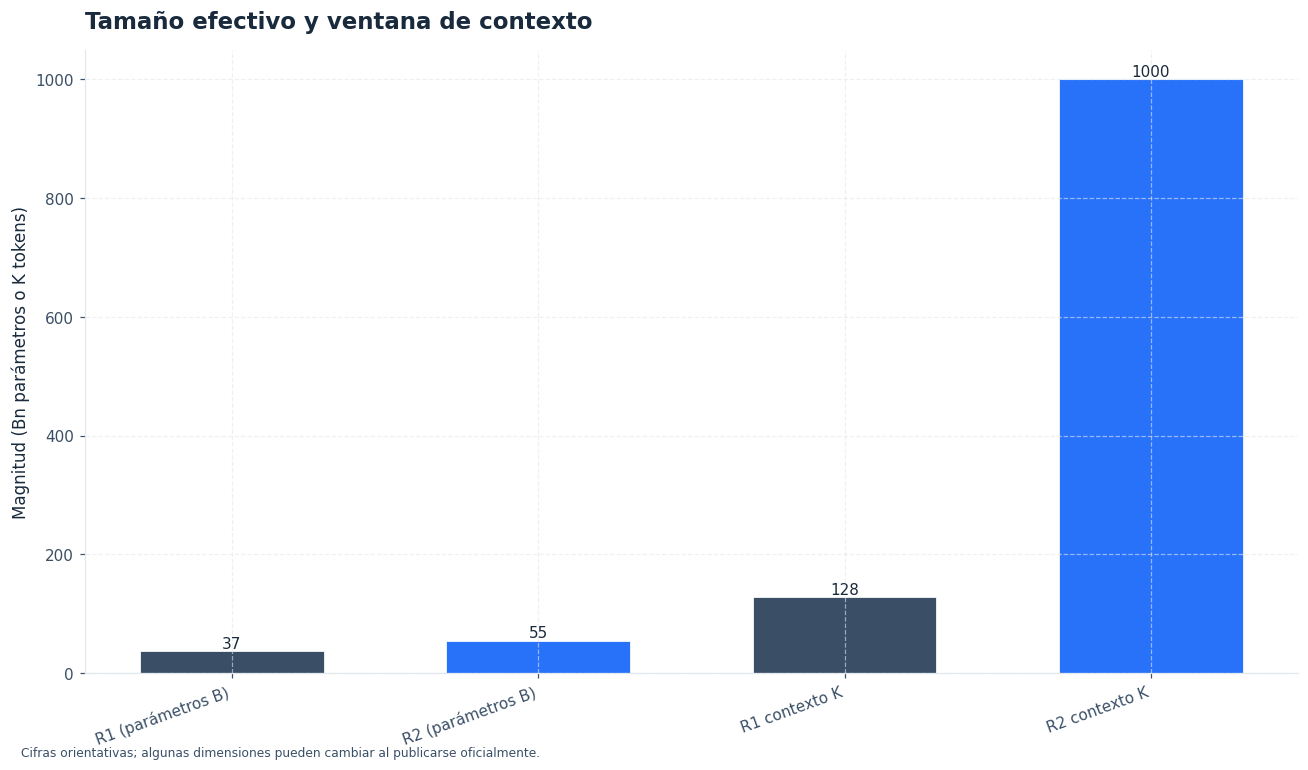

Esta tabla resume la situación operativa real en la API de DeepSeek. V3.2 sigue documentado como versión heredada, mientras que V4 es la referencia vigente para nuevos proyectos. En V4, tanto Flash como Pro comparten el salto fuerte en ventana de contexto: 1.000.000 de tokens de entrada y hasta 384K de tokens de salida [1][6].

En precio, V4 Flash es la opción claramente más agresiva. Cuesta $0,14 por 1M tokens de entrada con fallo de caché, $0,028 con acierto de caché y $0,28 por 1M tokens de salida. V4 Pro sube a $1,74 de entrada, $0,145 con caché y $3,48 de salida por 1M tokens [6]. En comparación, V3.2 queda en $0,28 de entrada, $0,028 con caché y $0,42 de salida por 1M tokens [8].

Si te interesa el análisis detallado de estas dos variantes, puedes ampliar con las fichas de DeepSeek V4 Flash y DeepSeek V4 Pro. Para una visión de costes, la guía central sigue siendo precios.

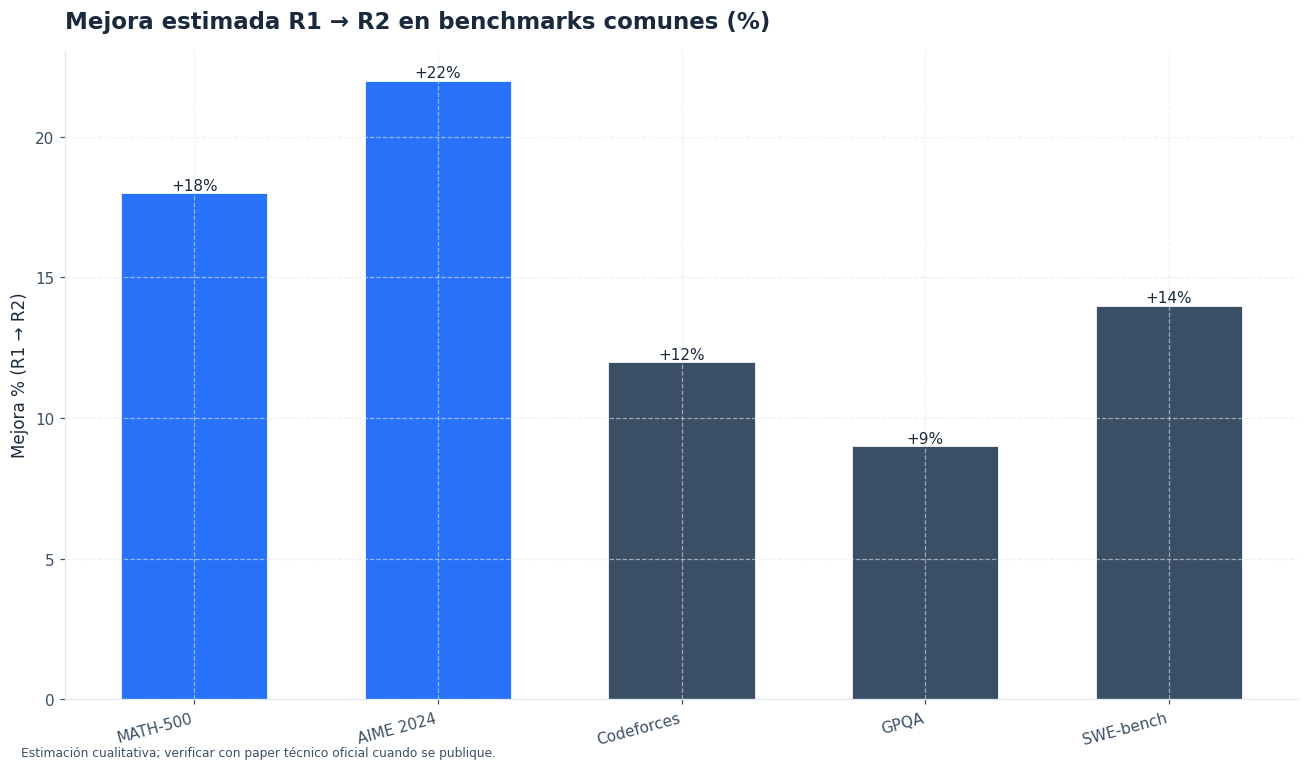

Benchmarks y mejoras: qué hay realmente frente a R1

Como no hay una ficha oficial de DeepSeek R2, no existen benchmarks verificados de “R2 vs R1”. Lo que sí existe es una mejora documentada de DeepSeek-R1-0528 dentro de la línea R1. En el registro de cambios de DeepSeek, esa actualización elevó el rendimiento Pass@1 en AIME 2025 de 70,0 a 87,5, en GPQA de 71,5 a 81,0, en LCB_v6 de 63,5 a 73,3 y en Aider de 57,0 a 71,6 [4].

Después, con V4 Preview, DeepSeek ya no presenta la discusión como “R1 mejorado”, sino como una familia nueva que supera a los modelos abiertos actuales en matemáticas, STEM y código, y que además mejora el rendimiento en tareas agentivas. La documentación pública no siempre ofrece en la misma página todas las tablas comparativas detalladas, pero sí fija esa posición competitiva general para V4 Pro y un posicionamiento cercano para V4 Flash [2].

Desde un punto de vista editorial, hay una conclusión útil. Si buscas la siguiente gran mejora en razonamiento dentro del ecosistema DeepSeek, hoy debes mirar dos escalones: primero, la revisión R1-0528; segundo, la transición más amplia hacia V4. Eso no confirma que R2 no vaya a llegar, pero sí indica que el mercado ya dispone de una “siguiente generación” funcional aunque use otra nomenclatura [2][4][5].

Qué conviene hacer hoy si estabas esperando DeepSeek R2

Si tu plan era esperar a deepseek r2 antes de integrar la API, lo más práctico es no bloquear el proyecto. La API actual ya expone modelos modernos con compatibilidad tipo OpenAI y una ruta base estable en https://api.deepseek.com; además, la documentación mantiene compatibilidad con software y SDK que ya hablan ese formato [3][9].

- Si quieres minimizar coste, empieza por DeepSeek V4 Flash [6].

- Si tu carga principal es razonamiento complejo, agentes o programación autónoma, prueba DeepSeek V4 Pro [2][6].

- Si aún dependes de

deepseek-chatodeepseek-reasoner, planifica la migración antes del 24 de julio de 2026 [1][3]. - Si estabas usando V3.2 por estabilidad histórica, revisa el salto a 1M de contexto de V4; en muchos flujos justifica la migración por sí solo [6][8].

- Si tu caso requiere pesos abiertos, DeepSeek ya ha publicado R1 y V4 como modelos abiertos, con licencia MIT según sus anuncios y documentación [2][5][9].

Este es un ejemplo mínimo en cURL para empezar a probar V4 sin esperar un hipotético R2:

curl https://api.deepseek.com/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer ${DEEPSEEK_API_KEY}" \

-d '{

"model": "deepseek-v4-flash",

"messages": [

{"role": "system", "content": "Responde de forma concisa y técnica."},

{"role": "user", "content": "Compara DeepSeek R1 con DeepSeek V4 Flash en coste y contexto."}

],

"stream": false

}'La propia documentación oficial indica que la API es compatible con el formato OpenAI y que basta con cambiar la URL base y el nombre del modelo para empezar [3]. Si quieres profundizar, la guía de API de DeepSeek y la documentación sobre V4 Flash o V4 Pro son el mejor punto de partida.

Preguntas frecuentes

¿DeepSeek R2 ya ha salido?

No hay un lanzamiento oficial de DeepSeek R2 verificado en las fuentes primarias públicas de DeepSeek a 7 de mayo de 2026. Lo confirmado hoy es DeepSeek R1, sus revisiones posteriores y la familia DeepSeek V4 [1][2][5].

¿Cuándo llega DeepSeek R2?

No hay fecha oficial publicada. Cualquier calendario que circule fuera de la documentación, GitHub oficial o anuncios de DeepSeek debe tratarse como especulación [1][4][7].

¿DeepSeek V4 sustituye a un posible R2?

No de forma declarada, pero en la práctica V4 ya ocupa el espacio de “siguiente generación” para muchos usos. Ofrece 1M de contexto, hasta 384K de salida, modos de razonamiento y una integración API más clara que la que antes se asociaba al alias deepseek-reasoner [1][2][6].

¿Qué pasa con deepseek-chat y deepseek-reasoner?

Se retirarán el 24 de julio de 2026. Durante la transición, ambos alias apuntan a DeepSeek V4 Flash: deepseek-chat al modo sin razonamiento y deepseek-reasoner al modo con razonamiento [1][3].

¿Los modelos de DeepSeek siguen siendo abiertos?

Sí. DeepSeek ha comunicado licencia MIT para R1 y también ha presentado V4 como abierto y con pesos publicados. La documentación de la API también muestra licencia MIT [2][5][9].

¿Qué modelo conviene usar mientras no exista R2?

Para coste y velocidad, V4 Flash. Para razonamiento exigente y tareas agentivas más duras, V4 Pro. Si solo quieres seguir con un alias heredado por compatibilidad, úsalo como transición, no como decisión a largo plazo [1][2][6].

Recursos relacionados

- DeepSeek en español

- Precios de DeepSeek

- Documentación de la API

- Probar DeepSeek Chat

- Análisis de DeepSeek V4 Flash

- Análisis de DeepSeek V4 Pro

Conclusión

Hoy no hay una ficha oficial de deepseek r2. Si buscabas novedades verificadas, la noticia real está en otro sitio: DeepSeek ya ha movido el listón con R1-0528 y, sobre todo, con V4. Por tanto, la decisión sensata no es esperar un nombre, sino evaluar las capacidades disponibles ahora. Si tu proyecto necesita coste bajo, empieza por V4 Flash. Si exige razonamiento fuerte y flujos con agentes, prueba V4 Pro. Y si todavía dependes de alias heredados, conviene migrar antes del 24 de julio de 2026 [1][2][3][6].