DeepSeek V4 Pro es el modelo más capaz de la familia DeepSeek V4, lanzada el 24 de abril de 2026, y está pensado para razonamiento profundo, código complejo y análisis de bases de código extensas. Importa porque combina 1M tokens de contexto, salida de hasta 384K tokens, pesos abiertos con licencia MIT y un modo thinking-max reservado para tareas difíciles.

Resumen rápido

- DeepSeek V4 Pro es la opción de mayor capacidad dentro de DeepSeek V4, por encima de DeepSeek V4 Flash.

- Admite 1M tokens de contexto y hasta 384K tokens de salida, útil para repositorios, documentación extensa y análisis largos.

- Incluye tres modos de razonamiento:

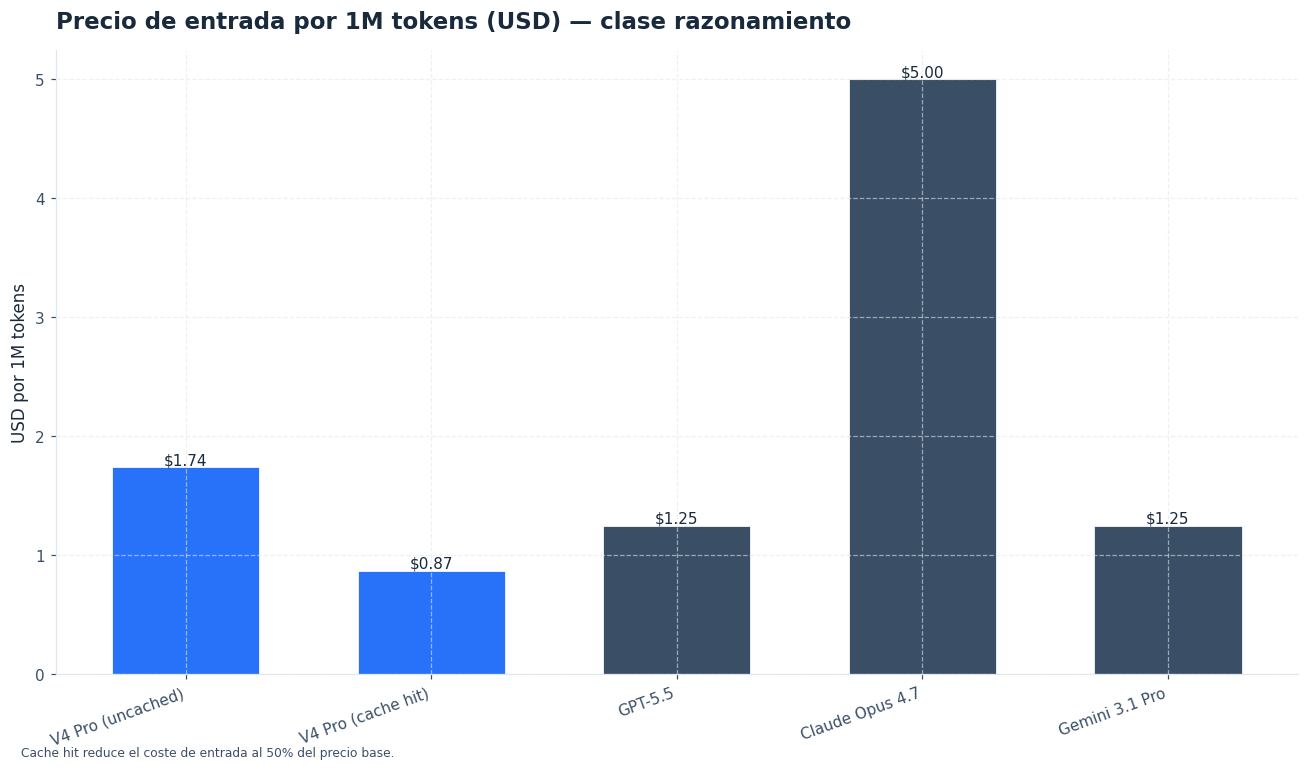

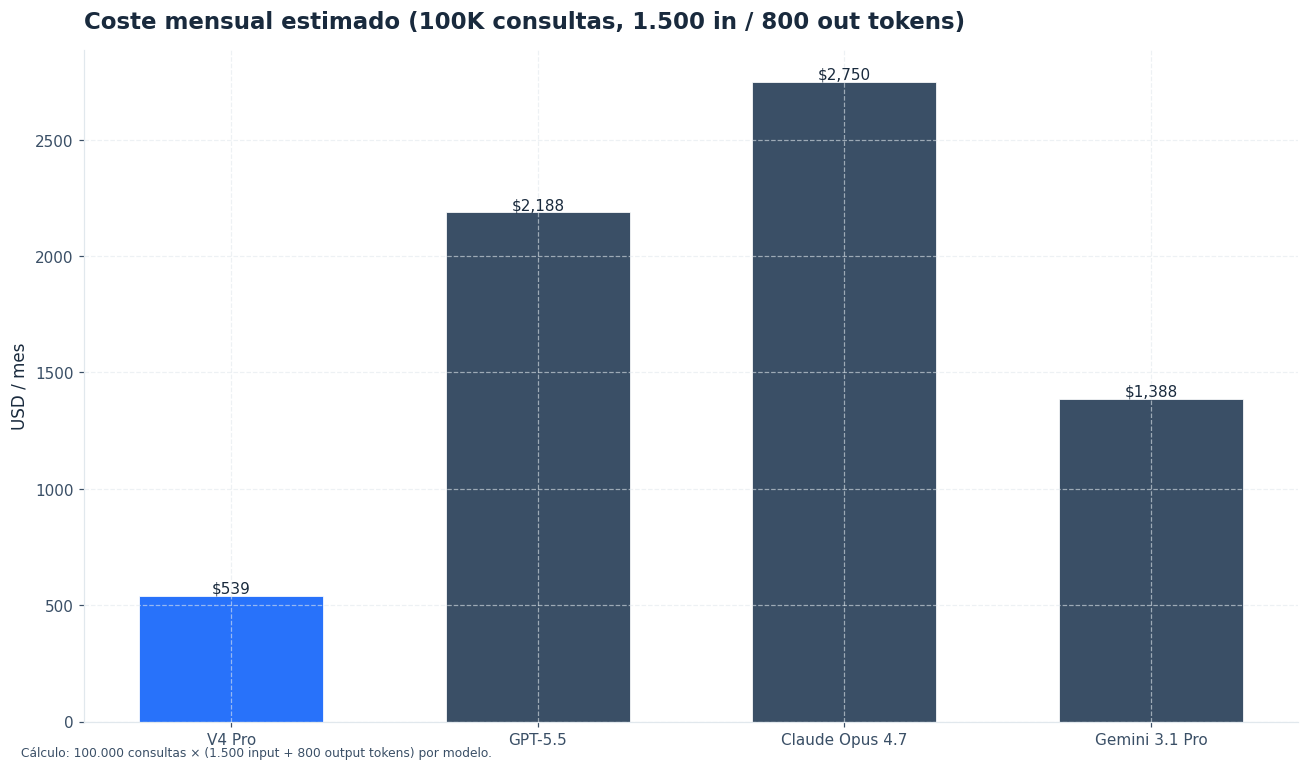

non-thinking,thinking-highythinking-max. El modothinking-maxsolo está disponible en Pro. - Su precio de referencia es $1,74 por 1M tokens de entrada, $3,48 por 1M tokens de salida y $0,87 por 1M tokens de entrada con caché.

- La API es compatible con el formato de OpenAI, así que la migración suele exigir pocos cambios en clientes existentes.

- Los alias heredados

deepseek-chatydeepseek-reasonerse deprecan el 24 de julio de 2026.

¿Qué es DeepSeek V4 Pro?

DeepSeek V4 Pro es el modelo insignia de la generación V4. Su función es cubrir tareas donde el coste de equivocarse, perder contexto o razonar de forma superficial pesa más que la latencia o el precio por token. Por eso encaja en flujos de ingeniería, revisión de código, análisis técnico, investigación asistida y automatización con agentes.

Dentro de la familia, DeepSeek V4 Flash está orientado a volumen, velocidad y coste bajo. DeepSeek V4 Pro se reserva para problemas más exigentes: planes de refactorización, depuración en varios archivos, lectura de documentación interna, generación de pruebas, razonamiento matemático y decisiones con varias restricciones.

El rasgo diferencial es thinking-max. Este modo permite dedicar más presupuesto de razonamiento a tareas que requieren explorar alternativas, verificar supuestos y mantener una cadena lógica larga. No sustituye a la validación humana, pero reduce el trabajo manual cuando la tarea necesita más que una respuesta directa.

También es relevante que los pesos sean abiertos con licencia MIT. Para equipos que evalúan dependencia de proveedor, auditoría o despliegues híbridos, esto facilita una estrategia más flexible que la de un modelo cerrado. Si solo quieres probarlo sin integrar la API, puedes empezar desde DeepSeek Chat.

Capacidades y casos de uso

DeepSeek V4 Pro brilla cuando el problema combina contexto largo, razonamiento y precisión. No está pensado para reemplazar a V4 Flash en cada llamada, sino para actuar como modelo principal en tareas de alto valor.

Razonamiento profundo y decisiones con restricciones

El modo thinking-max resulta útil para problemas donde la respuesta depende de varias condiciones. Por ejemplo, comparar arquitecturas de datos, revisar un plan de migración, evaluar riesgos de una integración o priorizar una hoja de ruta técnica con límites de coste, seguridad y plazo.

Código complejo y refactorizaciones

En ingeniería de software, DeepSeek V4 Pro encaja en tareas que no se resuelven con autocompletado. Puede leer un módulo grande, detectar dependencias implícitas, proponer una refactorización por fases y generar pruebas de regresión. Un caso típico sería migrar un servicio monolítico a módulos más pequeños sin romper contratos públicos.

Análisis de bases de código extensas

Con 1M tokens de contexto, el modelo puede trabajar con cantidades grandes de código, documentación y registros. Esto permite pedirle un mapa de dependencias, localizar rutas críticas, detectar duplicación o explicar por qué una función produce un fallo solo en ciertos entornos.

Documentación técnica y revisión de especificaciones

También puede revisar especificaciones largas, contratos de API, guías internas y documentos de producto. Por ejemplo, puede comparar una especificación OpenAPI con la implementación real, señalar inconsistencias y proponer cambios ordenados por impacto.

Agentes con herramientas

En flujos con herramientas, DeepSeek V4 Pro puede actuar como planificador. La práctica recomendada es usarlo para decidir la estrategia y delegar pasos repetitivos a modelos más baratos. Así, V4 Pro queda para planificación, verificación y recuperación ante errores.

Especificaciones técnicas

La tabla resume los datos clave para decidir si deepseek v4 pro encaja en tu arquitectura. Los precios están expresados por 1M tokens.

| Especificación | DeepSeek V4 Pro |

|---|---|

| Parámetros | No especificados en los datos verificados de esta página; pesos abiertos con licencia MIT |

| Contexto | 1M tokens |

| Modos de razonamiento | non-thinking, thinking-high, thinking-max |

| Precio de entrada | $1,74 por 1M tokens |

| Precio de salida | $3,48 por 1M tokens |

| Precio de entrada con caché | $0,87 por 1M tokens |

| Salida máxima | Hasta 384K tokens |

| ID de modelo | deepseek-v4-pro |

Si tu aplicación mezcla tareas sencillas y tareas difíciles, conviene enrutar cada petición. Usa DeepSeek V4 Flash para consultas frecuentes y DeepSeek V4 Pro para llamadas que necesiten razonamiento sostenido.

Cómo usar la API

DeepSeek V4 Pro se usa mediante una API compatible con OpenAI en https://api.deepseek.com/v1/. Si ya empleas clientes de Chat Completions, normalmente basta con cambiar la URL base, el identificador del modelo y el parámetro thinking. La guía principal está en documentación de la API.

# DeepSeek V4 Pro con thinking-max

curl https://api.deepseek.com/v1/chat/completions \

-H "Authorization: Bearer $DEEPSEEK_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "deepseek-v4-pro",

"thinking": "thinking-max",

"messages": [

{

"role": "system",

"content": "Eres un asistente técnico preciso. Verifica supuestos antes de responder."

},

{

"role": "user",

"content": "Analiza este plan de migración y detecta riesgos técnicos."

}

]

}'

# Variante de menor coste con DeepSeek V4 Flash

curl https://api.deepseek.com/v1/chat/completions \

-H "Authorization: Bearer $DEEPSEEK_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "deepseek-v4-flash",

"thinking": "thinking-high",

"messages": [

{

"role": "user",

"content": "Resume estos cambios de código y su impacto."

}

]

}'La regla práctica es sencilla: empieza con thinking-high para tareas técnicas normales y sube a thinking-max cuando necesites más verificación. Para costes de producción, revisa la página de precios de DeepSeek antes de fijar límites de uso.

Comparativa rápida

Las alternativas directas de DeepSeek V4 Pro son modelos cerrados de gama alta. GPT-5.5 aparece en la documentación de OpenAI con 1.050.000 tokens de contexto, 128K tokens de salida máxima y precio de $5,00 de entrada / $30,00 de salida por 1M tokens [1]. Anthropic presenta Claude Opus 4.7 como un modelo híbrido de razonamiento para código y agentes, con 1M tokens de contexto y precio desde $5,00 de entrada / $25,00 de salida por 1M tokens [2].

| Alternativa directa | Datos verificados | Cuándo elegirla frente a DeepSeek V4 Pro |

|---|---|---|

| GPT-5.5 | 1.050.000 tokens de contexto, 128K tokens de salida máxima, $5,00 de entrada y $30,00 de salida por 1M tokens [1] | Cuando tu pila ya depende de herramientas propias de OpenAI, Responses API o funciones alojadas de su plataforma. |

| Claude Opus 4.7 | 1M tokens de contexto, modelo orientado a código y agentes, $5,00 de entrada y $25,00 de salida por 1M tokens [2] | Cuando tu equipo prioriza el ecosistema Claude, Claude Code o integraciones empresariales nativas de Anthropic. |

Frente a esas opciones, DeepSeek V4 Pro compite por coste, apertura de pesos y salida larga. La decisión no debería basarse solo en precio por token. Mide coste por tarea resuelta, latencia, calidad de validación y facilidad de integración.

Limitaciones y consideraciones

DeepSeek V4 Pro no debe usarse como sustituto automático de revisión experta en seguridad, salud, legal, finanzas o decisiones irreversibles. Aunque el modo thinking-max mejora el razonamiento en tareas difíciles, el modelo puede omitir supuestos, interpretar mal requisitos ambiguos o generar código que compila pero no cumple la intención del sistema.

El contexto de 1M tokens tampoco elimina la necesidad de preparar bien la entrada. Si pasas un repositorio completo sin estructura, el modelo puede dedicar atención a archivos irrelevantes. Para análisis de código, conviene enviar árbol de directorios, archivos críticos, errores reproducibles y criterios de aceptación.

El coste también crece rápido con salidas largas. Usa caché cuando repitas contexto, limita la salida máxima y reserva thinking-max para tareas que lo justifiquen. En producción, registra métricas de tokens, tasa de reintentos y calidad por caso de uso.

Migración desde versiones previas

Si vienes de V3.2 o de los alias heredados, migra a identificadores explícitos. Sustituye deepseek-chat por deepseek-v4-flash o deepseek-v4-pro según el caso. Sustituye deepseek-reasoner por el modelo V4 elegido y define thinking de forma explícita.

Los alias deepseek-chat y deepseek-reasoner se deprecan el 24 de julio de 2026. Antes de esa fecha, revisa la guía de migración desde DeepSeek V3.2, confirma límites en precios y actualiza tus clientes siguiendo la documentación de API.

Preguntas frecuentes

¿DeepSeek V4 Pro es mejor que DeepSeek V4 Flash?

Depende de la tarea. DeepSeek V4 Pro es mejor para razonamiento profundo, código complejo y análisis largo. DeepSeek V4 Flash es más adecuado para alto volumen, respuestas rápidas y tareas donde el coste por token pesa más.

¿Qué es thinking-max?

thinking-max es el modo de razonamiento más intensivo de la familia V4. Está disponible solo en DeepSeek V4 Pro y conviene usarlo en tareas con varias restricciones, verificación de supuestos o planificación técnica difícil.

¿Puedo usar DeepSeek V4 Pro con clientes de OpenAI?

Sí. La API usa un formato compatible con OpenAI en https://api.deepseek.com/v1/. En muchos proyectos basta con cambiar la URL base, la clave, el modelo y el parámetro thinking.

¿Cuándo conviene pagar por DeepSeek V4 Pro?

Conviene usarlo cuando el valor de una respuesta correcta supera el coste adicional. Ejemplos: revisión de arquitectura, refactorizaciones grandes, depuración compleja, análisis de contratos de API o planificación con agentes.

¿DeepSeek V4 Pro tiene pesos abiertos?

Sí. La familia DeepSeek V4 se publicó con pesos abiertos bajo licencia MIT, lo que facilita auditoría, experimentación y estrategias de despliegue más flexibles.

Conclusión

DeepSeek V4 Pro es la opción adecuada cuando necesitas más razonamiento, más contexto y más control que con un modelo rápido de uso general. Empieza probando el mismo flujo con V4 Flash y V4 Pro, mide coste por tarea resuelta y reserva thinking-max para los casos donde aporte valor real. Para una integración limpia, consulta la página principal, revisa precios y sigue la guía de API.

Fuentes

’]