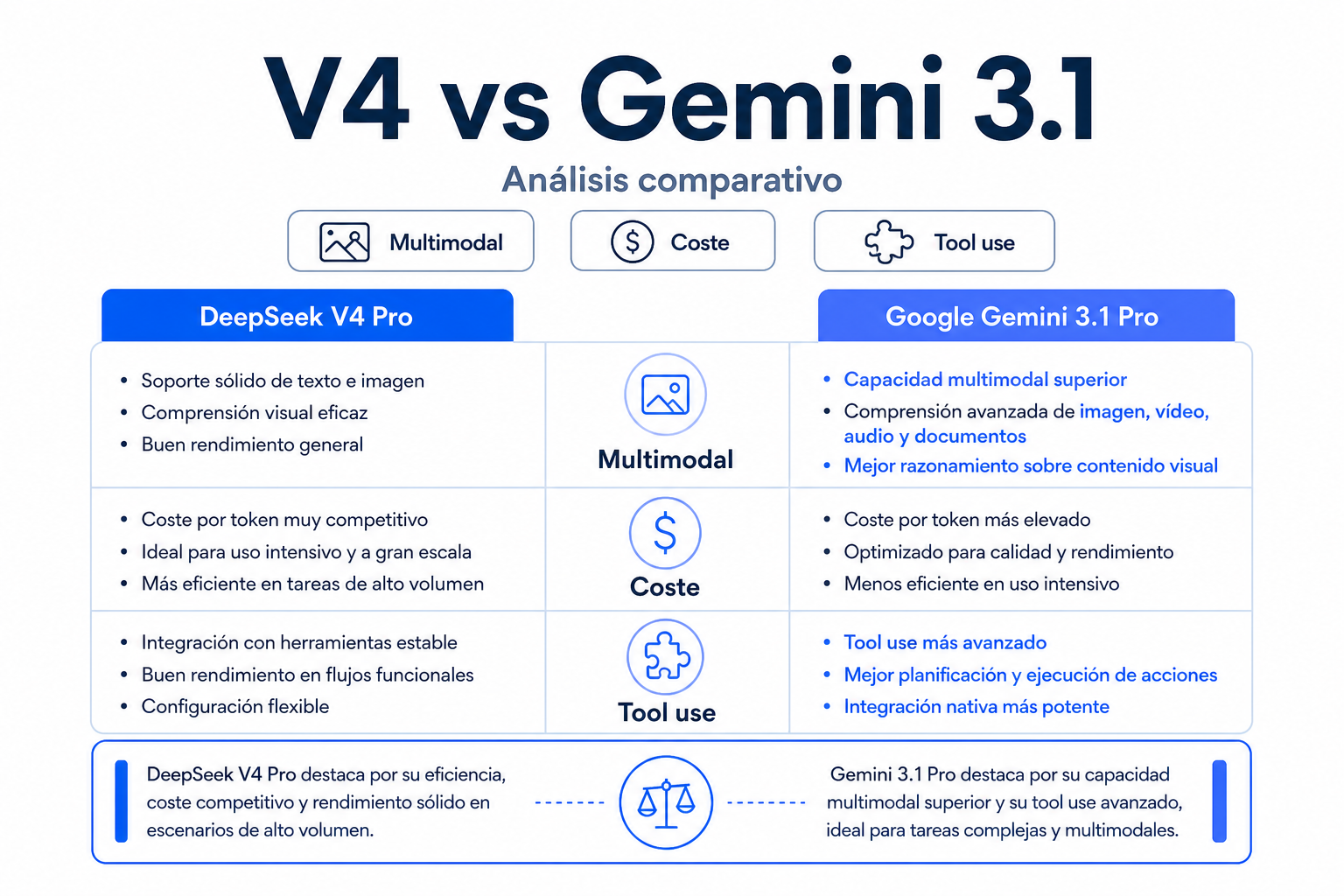

La comparación DeepSeek V4 vs Gemini 3.1 enfrenta dos enfoques distintos: DeepSeek V4 Pro prioriza razonamiento textual, coste y control de despliegue; Google Gemini 3.1 Pro destaca por multimodalidad nativa e integración con el ecosistema Google. Si vas a elegir modelo para producto, automatización o análisis avanzado, la decisión depende menos del “mejor modelo” y más del tipo de trabajo, datos y presupuesto.

Resumen rápido

- Gemini 3.1 Pro gana en multimodalidad: acepta texto, imágenes, audio y vídeo, con una ventana de contexto de hasta 1M tokens según la ficha de Google DeepMind [2].

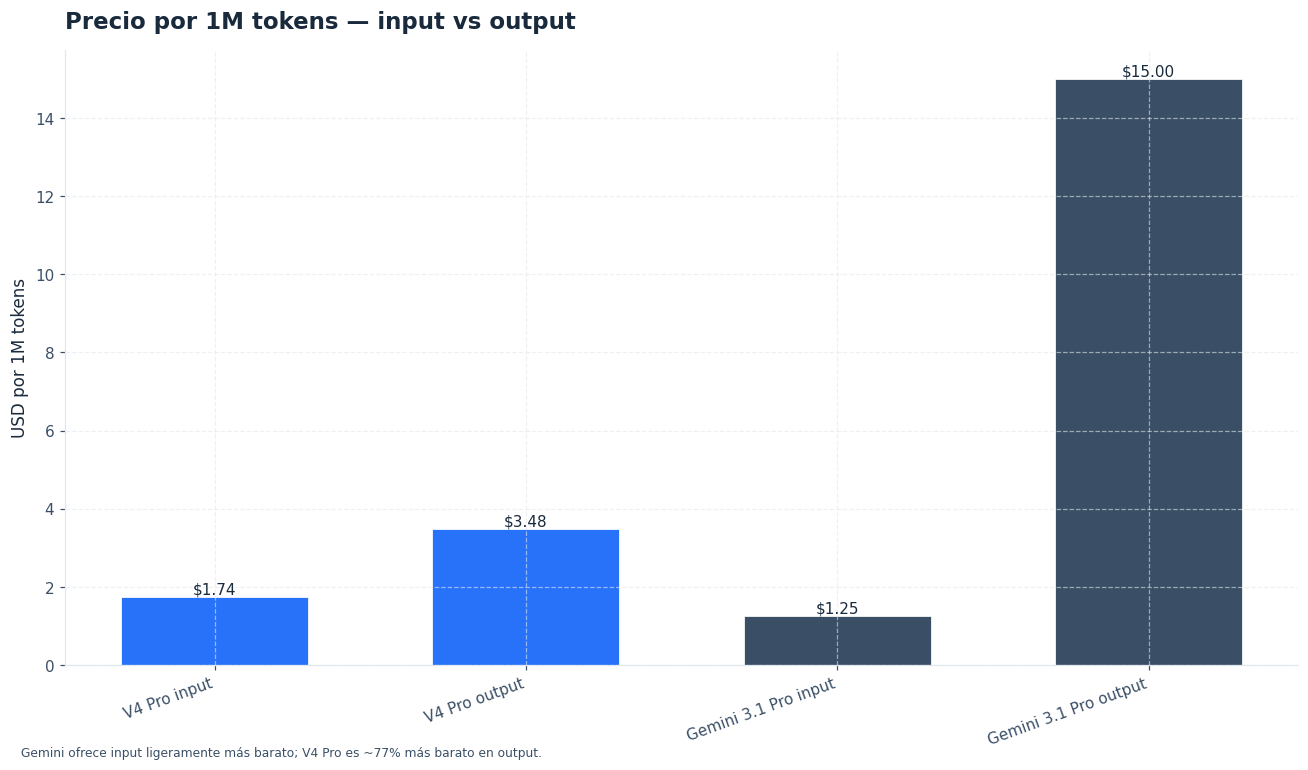

- DeepSeek V4 Pro gana en coste base de salida: $3,48 por 1M tokens de salida frente a $12,00 en Gemini 3.1 Pro estándar para prompts de hasta 200K tokens [1][4].

- DeepSeek V4 Pro encaja mejor en razonamiento textual puro, código, agentes con herramientas y tareas donde el control de inferencia pesa más que la integración de plataforma.

- Gemini 3.1 Pro es más cómodo para equipos ya integrados en Google, sobre todo si trabajan con Gmail, Drive, Docs, Sheets, Calendar, NotebookLM, Vertex AI o Google AI Studio [3][5].

- DeepSeek V4 tiene pesos abiertos bajo licencia MIT, un punto clave si necesitas autoalojamiento, auditoría, ajuste interno o evitar dependencia total de una API cerrada.

- La cifra de $1,25/$15 no es la tarifa estándar actual de Gemini 3.1 Pro consultada el 7 de mayo de 2026; la página oficial muestra $2,00/$12,00 en estándar hasta 200K tokens [1].

DeepSeek V4 vs Gemini 3.1: veredicto por caso de uso

La comparativa DeepSeek V4 vs Gemini 3.1 no se resuelve con una única métrica. Gemini 3.1 Pro es más fuerte cuando la entrada combina documentos, imágenes, audio o vídeo. También resulta atractivo si el equipo ya trabaja dentro de Google Workspace y quiere usar IA donde ya están sus archivos.

DeepSeek V4 Pro apunta a otro perfil. Es una opción más eficiente para razonamiento textual, programación, agentes con herramientas, análisis largo y despliegues donde el coste por token importa. Si quieres probar la familia completa, puedes revisar la página de DeepSeek V4 o ir directamente a DeepSeek V4 Pro.

La diferencia práctica aparece al escalar. En un prototipo pequeño, el precio puede parecer secundario. En un producto con millones de tokens diarios, la salida de Gemini 3.1 Pro puede multiplicar el coste frente a DeepSeek V4 Pro. En flujos multimodales, ese sobrecoste puede compensar si evitas construir varias canalizaciones separadas.

La decisión rápida es esta: usa Gemini 3.1 Pro si tu aplicación depende de multimodalidad nativa o del ecosistema Google. Usa DeepSeek V4 Pro si el núcleo es razonamiento textual, código, coste, privacidad operativa o posibilidad de autoalojamiento.

Tabla comparativa de especificaciones

Esta tabla resume los puntos que más suelen afectar a arquitectura, costes y experiencia de uso. Los datos de Gemini se verificaron en fuentes oficiales de Google el 7 de mayo de 2026 [1][2][3]. Los datos de DeepSeek V4 corresponden a la documentación y ficha editorial de DeepSeek en mayo de 2026 [4].

| Área | DeepSeek V4 Pro | Google Gemini 3.1 Pro |

|---|---|---|

| Modelo principal comparado | deepseek-v4-pro | gemini-3.1-pro-preview |

| Enfoque | Razonamiento textual, código, agentes, coste y despliegue controlado | Razonamiento avanzado, multimodalidad y productos Google |

| Contexto | 1M tokens | Hasta 1M tokens [2] |

| Salida máxima | Hasta 384K tokens | 65.536 tokens en la familia Gemini 3 Pro según la documentación de modelos disponible [2] |

| Modalidades | Texto como flujo principal; integración con herramientas y salida estructurada | Texto, imágenes, audio y vídeo como entradas nativas [2] |

| Modos de razonamiento | non-thinking, thinking-high y thinking-max en Pro | Pensamiento y capacidades de razonamiento integradas en Gemini 3.1 Pro [2] |

| Pesos abiertos | Sí, licencia MIT | No; modelo cerrado de Google |

| API | Compatible con formato OpenAI en https://api.deepseek.com/v1/ | Gemini API, Vertex AI y Google AI Studio [3] |

| Mejor encaje | Razonamiento, código, costes bajos, autoalojamiento, control de datos | Multimodalidad, Google Workspace, NotebookLM, Vertex AI, flujos con archivos de Google |

Para tareas de texto y código, DeepSeek V4 Pro ofrece una relación coste-capacidad difícil de ignorar. Para tareas con vídeo, capturas, audio o documentos dispersos en Google Drive, Gemini 3.1 Pro reduce fricción. En esa zona, la comparación DeepSeek V4 vs Gemini 3.1 favorece a Gemini por producto, no solo por modelo.

Costes: tokens de entrada, salida y caché

El coste es uno de los criterios más claros. En DeepSeek V4 Pro, la tarifa base indicada para planificación es $1,74 por 1M tokens de entrada y $3,48 por 1M tokens de salida. DeepSeek V4 Flash baja a $0,14 de entrada y $0,28 de salida, con un perfil más adecuado para volumen [4]. Puedes ampliar la parte comercial en la página de precios de DeepSeek.

En Gemini 3.1 Pro, la tarifa estándar oficial consultada el 7 de mayo de 2026 es $2,00 por 1M tokens de entrada y $12,00 por 1M tokens de salida para prompts de hasta 200K tokens. Si el prompt supera 200K tokens, Google muestra $4,00 de entrada y $18,00 de salida. Google también publica opciones Batch, Flex y Priority con tarifas diferentes [1].

| Modelo / nivel | Entrada por 1M tokens | Salida por 1M tokens | Caché / notas |

|---|---|---|---|

| DeepSeek V4 Flash | $0,14 | $0,28 | Acierto de caché de entrada: $0,028 en la tarifa base editorial |

| DeepSeek V4 Pro | $1,74 | $3,48 | Acierto de caché de entrada: $0,87 en la tarifa base editorial |

| Gemini 3.1 Pro Standard, ≤ 200K tokens | $2,00 | $12,00 | Caché de contexto: $0,20 por 1M tokens [1] |

| Gemini 3.1 Pro Standard, > 200K tokens | $4,00 | $18,00 | Caché de contexto: $0,40 por 1M tokens [1] |

| Gemini 3.1 Pro Batch/Flex, ≤ 200K tokens | $1,00 | $6,00 | Opción útil para trabajos no interactivos [1] |

| Gemini 3.1 Pro Priority, ≤ 200K tokens | $3,60 | $21,60 | Prioriza capacidad y latencia [1] |

La lectura económica es directa. Si tu producto genera respuestas largas, DeepSeek V4 Pro suele reducir el gasto. Si tu carga se puede mandar en Batch o Flex y no requiere baja latencia, Gemini 3.1 Pro se acerca más, aunque sigue por encima en salida frente al precio base de DeepSeek V4 Pro.

La cifra de $1,25 de entrada y $15 de salida por 1M tokens aparece a menudo en conversaciones sobre Gemini, pero no describe la tarifa estándar actual de Gemini 3.1 Pro. En la página oficial, esos valores se parecen más a tramos de Gemini 2.5 Pro o a combinaciones de contexto largo, no al precio estándar de gemini-3.1-pro-preview el 7 de mayo de 2026 [1].

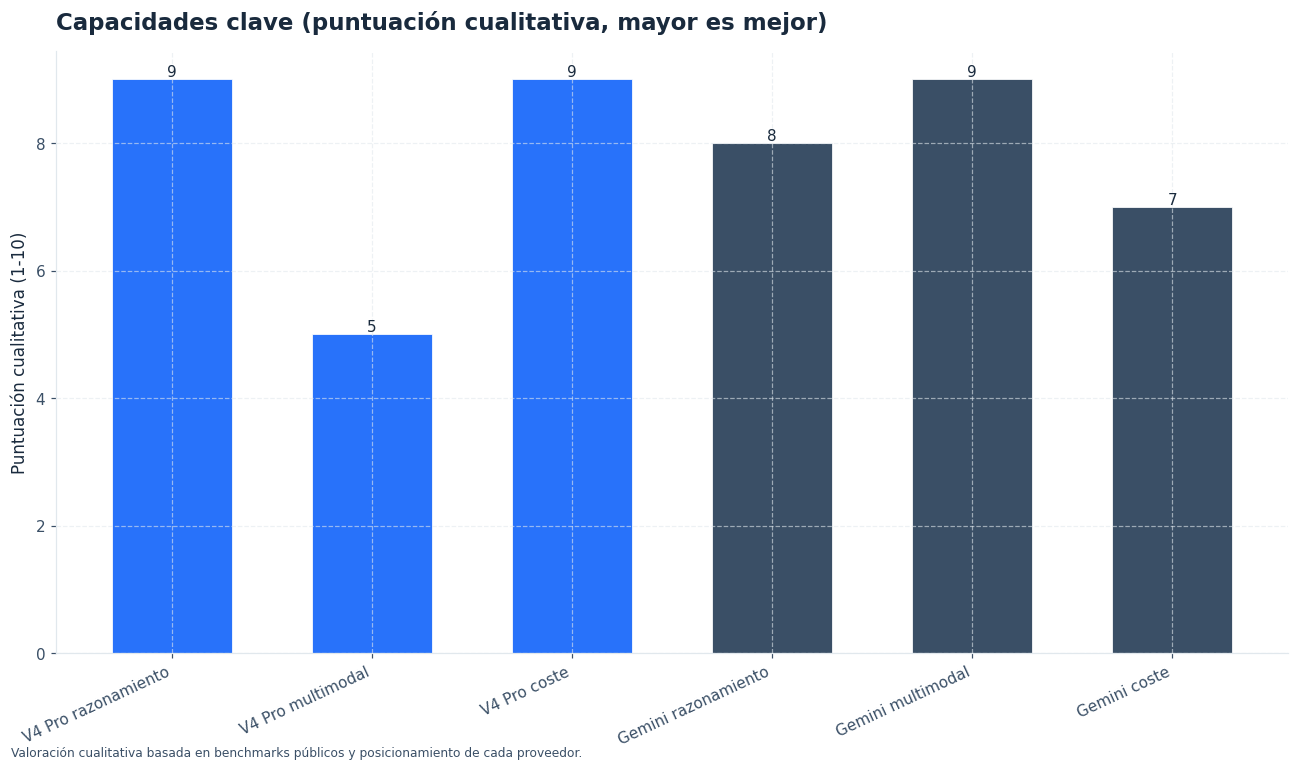

Razonamiento, código y agentes

DeepSeek V4 Pro es especialmente competitivo cuando el trabajo depende de razonamiento paso a paso sobre texto, código o llamadas a herramientas. Sus tres modos permiten ajustar coste y profundidad: non-thinking para respuestas directas, thinking-high para tareas complejas y thinking-max cuando necesitas exprimir el razonamiento del modelo.

Este diseño es útil en agentes que revisan repositorios, generan planes de migración, escriben pruebas, transforman datos o crean respuestas estructuradas. La API compatible con OpenAI simplifica el cambio desde bibliotecas existentes. Si ya usas clientes que apuntan a /v1/chat/completions, la migración puede limitarse a cambiar la URL base, el modelo y la clave.

Gemini 3.1 Pro también tiene razonamiento avanzado. Google lo presenta como un modelo para tareas complejas, agentes y comprensión multimodal [2][3]. Su ventaja aparece cuando el razonamiento necesita interpretar capturas, diagramas, vídeos, audios o documentos visuales. Ahí DeepSeek V4 Pro necesita una canalización externa para convertir esas entradas a texto o descripciones.

Para equipos de desarrollo que trabajan sobre texto y código, DeepSeek V4 Pro resulta más directo. Puedes revisar ejemplos y parámetros en la documentación API de DeepSeek. Si buscas una variante barata para clasificación, extracción o preprocesado masivo, DeepSeek V4 Flash puede actuar como modelo auxiliar.

Multimodalidad y ecosistema Google

Gemini 3.1 Pro gana con claridad si el trabajo es multimodal. La ficha de Google DeepMind indica soporte para texto, imágenes, audio y vídeo, con contexto de hasta 1M tokens [2]. Esto reduce capas intermedias y permite razonar sobre materiales que no son solo texto.

En la práctica, esto afecta a casos como revisión de clases grabadas, análisis de reuniones, comprensión de material visual, lectura de capturas de interfaz o extracción de información desde documentos escaneados. Gemini puede recibir esas entradas de forma más natural. En DeepSeek V4 Pro tendrías que integrar un modelo de visión, OCR o transcripción antes del razonamiento.

El otro punto fuerte es Google Workspace. La integración de Gemini con aplicaciones como Gmail, Drive, Docs, Calendar, Keep y Tasks ya está disponible en la aplicación de Gemini para Workspace en contextos compatibles [5]. Google también sitúa Gemini 3.1 Pro en Gemini API, Vertex AI, la aplicación de Gemini y NotebookLM [3].

Si tu empresa vive en Drive, Docs y Sheets, Gemini puede ahorrar trabajo de integración. Si tu producto necesita un modelo embebido en una arquitectura propia, DeepSeek V4 Pro mantiene más libertad. Esta diferencia pesa más que una variación pequeña en una prueba de referencia.

Privacidad, control y autoalojamiento

DeepSeek V4 Pro tiene una ventaja estructural: pesos abiertos con licencia MIT. Esto no significa que cualquier equipo pueda autoalojarlo de forma barata, porque los requisitos de hardware pueden ser elevados. Sí significa que una organización con infraestructura, socios de inferencia o exigencias de auditoría puede tener más control que con un modelo cerrado.

El autoalojamiento importa cuando hay datos sensibles, restricciones regulatorias, latencia interna o necesidad de modificar la pila de inferencia. También permite evaluar el modelo sin depender por completo de cambios de política, límites de uso o decisiones de producto de un proveedor externo.

Gemini 3.1 Pro ofrece el camino opuesto: menos control sobre el modelo, más integración gestionada. Para muchas empresas, esto es una ventaja. Vertex AI, Google Cloud, Google Workspace y Google AI Studio reducen carga operativa. El equipo no tiene que mantener infraestructura de inferencia ni adaptar pesos.

Por tanto, la comparación DeepSeek V4 vs Gemini 3.1 depende del tipo de control que necesitas. Si prefieres delegar plataforma, seguridad gestionada y conectores, Gemini encaja. Si necesitas portabilidad, auditoría y libertad técnica, DeepSeek V4 Pro es más atractivo.

API, migración y ejemplo cURL

DeepSeek V4 Pro facilita la adopción con una API compatible con el formato de OpenAI. La base recomendada es https://api.deepseek.com/v1/. Los alias heredados deepseek-chat y deepseek-reasoner quedan obsoletos el 24 de julio de 2026, así que conviene migrar a identificadores explícitos como deepseek-v4-pro y deepseek-v4-flash.

curl https://api.deepseek.com/v1/chat/completions \

-H "Authorization: Bearer $DEEPSEEK_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "deepseek-v4-pro",

"messages": [

{

"role": "system",

"content": "Responde con razonamiento claro y salida estructurada."

},

{

"role": "user",

"content": "Compara dos estrategias de migración de base de datos y recomienda una."

}

],

"reasoning_mode": "thinking-high",

"temperature": 0.2

}'Este patrón encaja bien con aplicaciones que ya usan clientes OpenAI, LangChain, LlamaIndex o agentes propios. Para probar respuestas interactivas antes de integrar la API, puedes usar el chat de DeepSeek. Para una visión general del sitio, entra en DeepSeek en español.

Gemini 3.1 Pro requiere el cliente o la API de Google. Esa integración es más natural si tu equipo ya usa Google Cloud o Vertex AI. También es la ruta más lógica si necesitas conectar el modelo a NotebookLM, Google AI Studio o flujos internos de Workspace.

Qué modelo elegir según tu escenario

Elige DeepSeek V4 Pro si tu caso principal es razonamiento sobre texto, código o datos estructurados. También si vas a generar muchas respuestas largas, quieres reducir coste por token o necesitas un modelo con pesos abiertos. Es la opción más pragmática para agentes de programación, análisis de documentos ya convertidos a texto, extracción compleja y tareas con salidas extensas.

Elige Gemini 3.1 Pro si tus entradas no son solo texto. Reuniones grabadas, imágenes, documentos visuales, vídeos de formación, interfaces y datos repartidos por Google Workspace favorecen a Gemini. También es mejor si tu equipo quiere usar IA sin construir una pila técnica completa.

En muchos productos, la mejor arquitectura será híbrida. Puedes usar Gemini para interpretar material multimodal y DeepSeek V4 Pro para razonamiento textual, generación larga o validación posterior. También puedes reservar DeepSeek V4 Flash para tareas de alto volumen y dejar DeepSeek V4 Pro para las decisiones más difíciles.

La comparación DeepSeek V4 vs Gemini 3.1 no exige fidelidad a un único proveedor. En producción, lo sensato es medir coste por tarea completada, tasa de errores, latencia, facilidad de integración y coste de mantenimiento. El precio por token ayuda, pero no sustituye una prueba con tus datos reales.

Preguntas frecuentes

¿DeepSeek V4 Pro es mejor que Gemini 3.1 Pro?

Depende del uso. DeepSeek V4 Pro es más atractivo para razonamiento textual, código, coste y control de despliegue. Gemini 3.1 Pro es mejor si necesitas multimodalidad nativa, integración con Google Workspace o uso directo desde productos de Google.

¿Gemini 3.1 Pro cuesta $1,25 de entrada y $15 de salida?

No como tarifa estándar actual de Gemini 3.1 Pro consultada el 7 de mayo de 2026. Google publica $2,00/$12,00 por 1M tokens en Standard hasta 200K tokens, y $4,00/$18,00 cuando el prompt supera 200K tokens [1].

¿DeepSeek V4 Pro tiene pesos abiertos?

Sí. DeepSeek V4 Pro se presenta con pesos abiertos bajo licencia MIT. Esto favorece auditoría, portabilidad y despliegues propios, aunque el autoalojamiento de un modelo Pro exige infraestructura potente y experiencia de inferencia.

¿Cuál conviene para analizar vídeo, audio e imágenes?

Gemini 3.1 Pro. La ficha de Google DeepMind indica soporte nativo para texto, imágenes, audio y vídeo [2]. DeepSeek V4 Pro puede participar en el flujo, pero necesitaría modelos externos para convertir esas modalidades a texto o metadatos.

¿Puedo migrar desde los alias deepseek-chat y deepseek-reasoner?

Sí. Conviene migrar antes del 24 de julio de 2026. Usa identificadores actuales como deepseek-v4-flash o deepseek-v4-pro, y revisa los modos de razonamiento para mantener el comportamiento esperado.

Conclusión

Si tu prioridad es razonamiento textual, código, coste por salida y control técnico, DeepSeek V4 Pro es la opción más sólida. Si tu aplicación depende de imágenes, audio, vídeo o archivos ya integrados en Google, Gemini 3.1 Pro será más cómodo y completo. La mejor decisión es probar ambos con tus datos: mide coste por tarea resuelta, latencia, precisión y esfuerzo de integración. Para empezar por DeepSeek, revisa la API, compara precios y valida el comportamiento en el chat.

Fuentes

’]