DeepSeek

DeepSeek es una familia de modelos de lenguaje diseñada para generar texto, asistir en programación, analizar información y operar mediante interfaces de chat y API. Este sitio existe como guía editorial independiente en español, no afiliada a DeepSeek, orientada a cualquier persona hispanohablante que necesite entender el servicio sin depender de comunicados comerciales ni documentación dispersa. Aquí se explica qué es DeepSeek, cómo funciona el chat de DeepSeek, qué diferencias presentan los modelos vigentes V4 Pro y V4 Flash, y cómo evaluar su rendimiento según precisión, velocidad, contexto, seguridad y costo. También se reúne información práctica sobre la documentación de la API, autenticación, límites de uso, integración en productos, compatibilidad con flujos existentes y criterios para comparar planes y precios. El lector encontrará además casos de uso para redacción, soporte, análisis de datos, desarrollo de software, investigación y automatización, con explicaciones verificables, contexto técnico y actualización editorial a 2026.

¿Qué es DeepSeek?

Definición y alcance

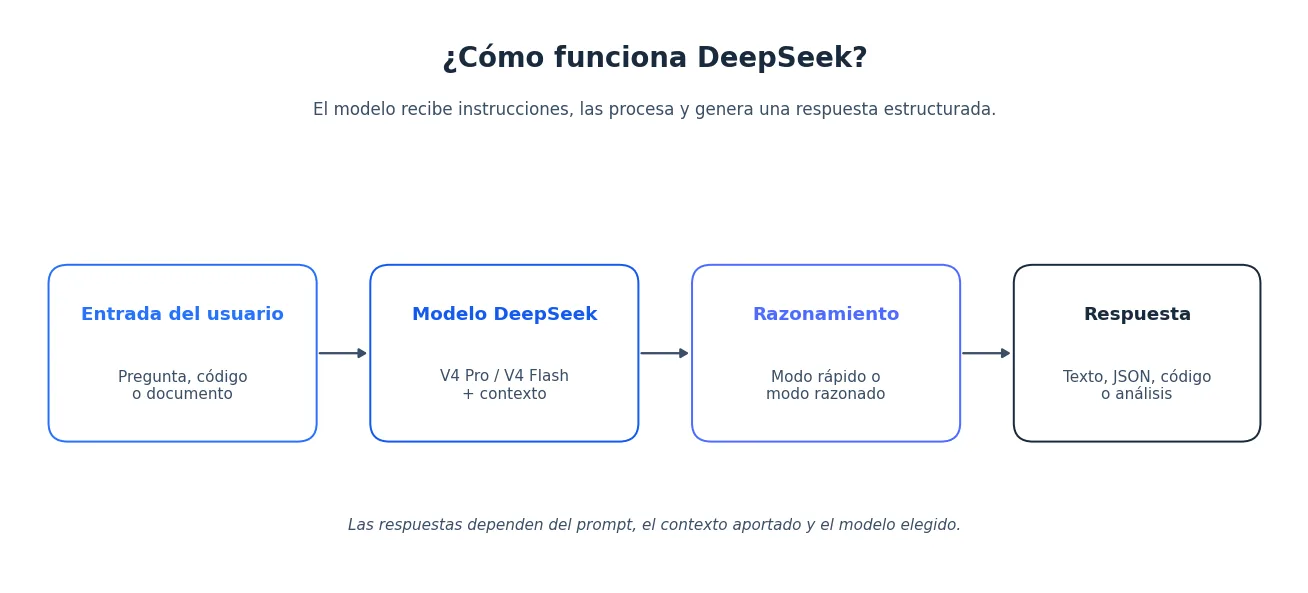

DeepSeek es una familia de modelos de lenguaje de gran tamaño, conocidos como LLM, diseñada para comprender instrucciones y generar texto, código y análisis a partir del contexto que recibe. Puede responder preguntas, resumir documentos, redactar borradores, traducir, explicar errores de programación o ayudar a ordenar información compleja. No funciona como un buscador tradicional: produce una respuesta probable según el modelo, la instrucción y los datos que aportas.

La forma más sencilla de probarlo es mediante un chat. Escribes una consulta, defines el tono o el formato esperado y revisas la salida. Para usarlo bien conviene dar contexto, límites y criterios de verificación. Si quieres empezar sin preparar una integración técnica, entra en el chat de DeepSeek en español y prueba tareas concretas, no preguntas demasiado generales.

DeepSeek Español es un sitio independiente, informativo y no afiliado a DeepSeek. Reunimos guías, comparativas y herramientas para hispanohablantes que necesitan entender modelos, API, precios, privacidad y seguridad sin depender de traducciones dispersas. Para temas sensibles, consulta siempre la documentación del proveedor y nuestras páginas de política de privacidad y seguridad.

- Úsalo como apoyo para pensar, redactar, programar y revisar.

- Verifica datos recientes, citas, cálculos y decisiones de riesgo.

- Evita enviar información confidencial sin una evaluación previa.

¿Por qué elegir DeepSeek en español?

Ventajas prácticas

Elegir DeepSeek en español tiene sentido cuando quieres una IA capaz de trabajar con instrucciones naturales, documentación extensa y flujos técnicos sin cambiar de idioma. Para usuarios no técnicos, el valor está en preguntar, resumir y redactar con claridad. Para desarrolladores, está en pasar del chat a la API. Para empresas, está en evaluar una alternativa flexible dentro de una estrategia más amplia de automatización y análisis.

- Idioma: puedes pedir respuestas en español neutro, formal, técnico o académico.

- Contexto: V4 permite manejar documentos largos y conversaciones complejas.

- Modelos: hay opciones rápidas, opciones de razonamiento y modelos anteriores para compatibilidad.

- Herramientas: puedes medir consumo con el contador de tokens y estimar escenarios con la calculadora API.

La calidad de las respuestas depende mucho de la instrucción. En vez de pedir “resume esto”, funciona mejor indicar audiencia, longitud, formato, criterios y posibles riesgos. En programación, añade lenguaje, versión, error exacto y fragmento relevante. En documentos, separa objetivo, fuentes y tipo de salida esperada.

DeepSeek no sustituye la revisión humana. Es útil para acelerar borradores, análisis y clasificación, pero no debe tratarse como autoridad única en salud, finanzas, derecho, seguridad o decisiones que afecten a personas.

Novedades: DeepSeek V4 (2026)

Qué cambia con V4

En 2026, la línea vigente es DeepSeek V4, con dos variantes principales: DeepSeek V4 Pro y DeepSeek V4 Flash. La familia V4 fue lanzada para nuevos proyectos que necesitan más contexto, mejor control del razonamiento y una gestión más clara entre calidad, latencia y coste.

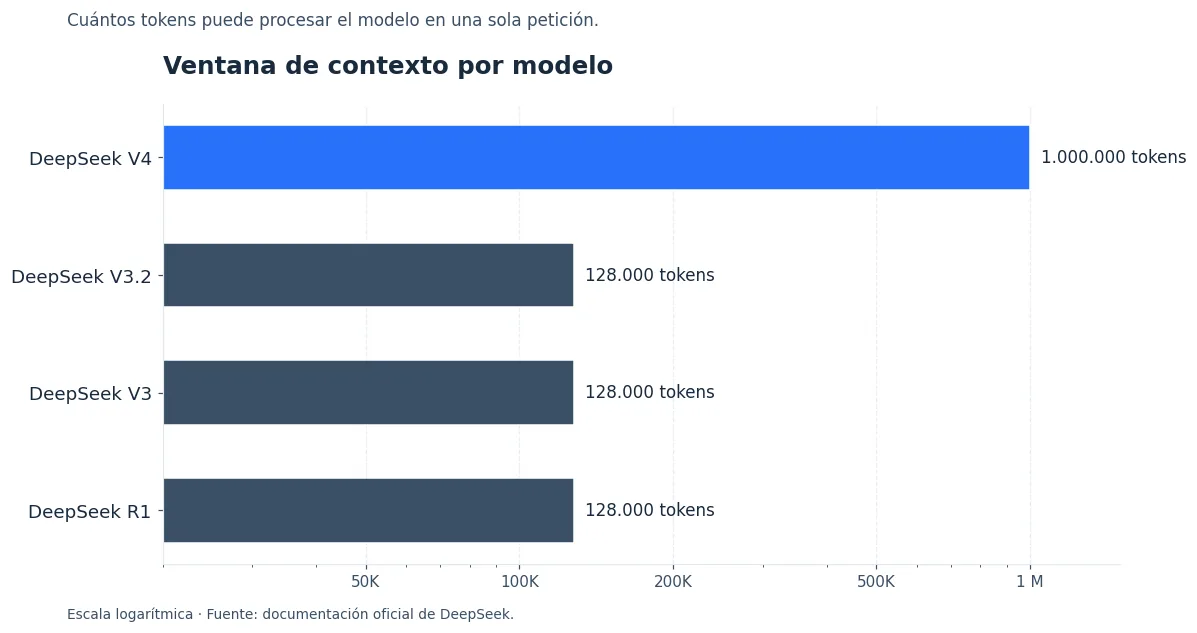

V4 admite una ventana de contexto de hasta 1 millón de tokens. Un token no equivale exactamente a una palabra: puede ser una palabra completa, parte de una palabra, puntuación o código. En la práctica, esto permite trabajar con contratos amplios, manuales, bases de conocimiento, historiales de soporte o partes extensas de un proyecto de software.

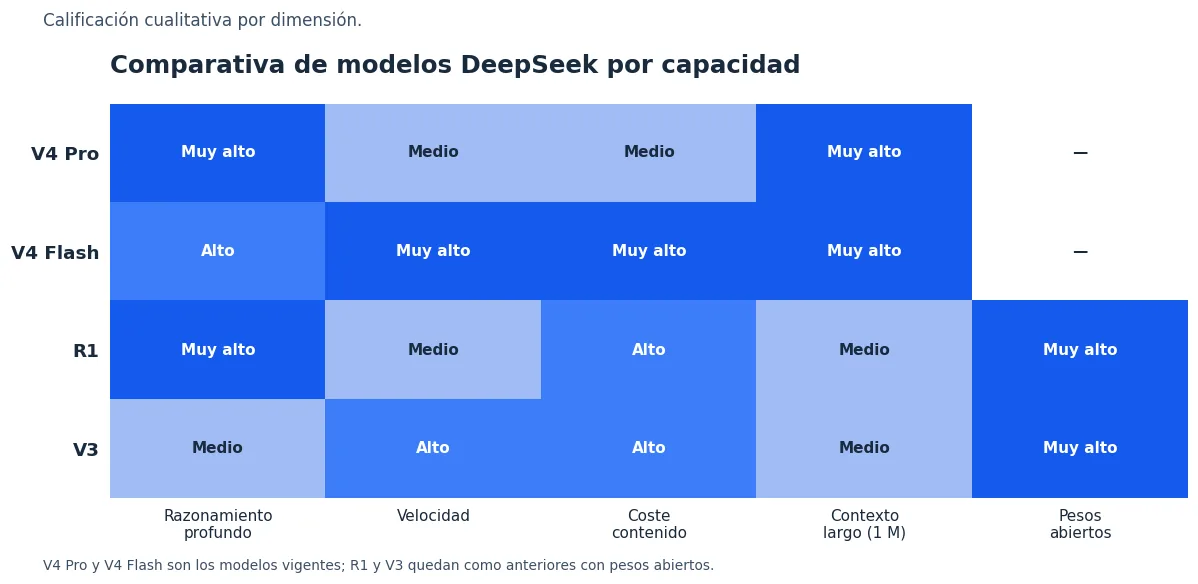

V4 también introduce modos de razonamiento, conocidos como thinking modes. No todas las tareas requieren el mismo esfuerzo: una clasificación breve puede resolverse en modo rápido, mientras que una revisión técnica o un problema lógico puede necesitar modo razonado. V4 Flash conmuta entre modo rápido y razonado; V4 Pro se orienta a tareas donde la profundidad pesa más que la velocidad.

DeepSeek OCR es otro componente relevante: se trata de un módulo dedicado al reconocimiento óptico de texto en imágenes y PDFs. Su función es extraer texto para que después pueda analizarse, resumirse o clasificarse con modelos de lenguaje. No conviene confundir OCR con comprensión visual general.

| Función | V4 Pro | V4 Flash | V3 / V3.2 | R1 |

|---|---|---|---|---|

| Ventana de contexto | 1 M tokens | 1 M tokens | 128 K tokens | 128 K tokens |

| Modos de razonamiento | Sí, integrados | Conmuta entre rápido y razonado | No | Razonamiento explícito |

| Estado a 2026 | Vigente | Vigente | Anterior | Anterior |

| Pesos abiertos | Según licencia oficial | Según licencia oficial | Sí (publicados) | Sí (publicados) |

| Mejor para | Razonamiento exigente, documentos largos | Volumen, soporte, automatizaciones | Despliegues existentes | Compatibilidad y razonamiento abierto |

Modelos de DeepSeek: V4 Pro, V4 Flash, V3 y R1

Cómo elegir modelo

La elección del modelo debe depender de la tarea, no de una preferencia abstracta. Para proyectos nuevos, V4 Flash suele ser el punto de partida cuando importan rapidez y eficiencia. V4 Pro encaja cuando hay razonamiento complejo, documentación larga o código con muchas dependencias. DeepSeek R1, lanzado en enero de 2025, y DeepSeek V3/V3.2 son modelos anteriores aún relevantes para compatibilidad, investigación y despliegues existentes.

| Modelo | Estado | Uso recomendado |

|---|---|---|

| DeepSeek V4 Pro | Modelo vigente de mayor capacidad dentro de V4 | Análisis largo, razonamiento exigente, programación compleja y revisión documental. |

| DeepSeek V4 Flash | Modelo vigente optimizado para rapidez | Chat general, soporte, resúmenes, clasificación, extracción de datos y automatizaciones frecuentes. |

| DeepSeek R1 | Modelo anterior de razonamiento | Compatibilidad con flujos ya creados, pruebas comparativas y despliegues que dependen de sus pesos publicados. |

| DeepSeek V3/V3.2 | Línea anterior conversacional | Proyectos heredados, pruebas locales, análisis técnico y migraciones controladas hacia V4. |

Una estrategia práctica es combinar modelos. Flash puede hacer el primer pase: limpiar texto, detectar intención o generar un borrador. Pro puede encargarse del segundo pase si hay ambigüedad, riesgo o necesidad de justificar una decisión. Así se equilibra latencia, coste y calidad.

Si ya usas R1, V3 o V3.2, no migres solo cambiando el nombre del modelo. Compara salidas, revisa formatos, mide tokens, actualiza pruebas y confirma que el nuevo comportamiento encaja con tus usuarios.

API para desarrolladores

De prototipo a producción

La API de DeepSeek permite integrar modelos en aplicaciones propias: asistentes de soporte, buscadores sobre documentación, revisión de código, extracción de datos, generación de informes o automatizaciones internas. Para empezar, consulta la documentación de la API, donde se explican autenticación, modelos, parámetros, límites, errores y ejemplos.

Una integración mínima suele enviar mensajes al modelo y recibir una respuesta de texto o JSON. En un producto real también necesitas controlar claves, usuarios, límites, registros, reintentos y validación de salida. Para crear credenciales, sigue la guía sobre cómo obtener una API key de DeepSeek y evita exponer claves en interfaces públicas.

- Modelo: decide V4 Pro, V4 Flash u otro modelo disponible según calidad, latencia y coste.

- Mensajes: separa instrucciones, contexto y conversación; no pegues documentos completos si solo necesitas una parte.

- Temperatura: usa valores bajos para extracción, soporte y formatos estables.

- Salida máxima: limita respuestas largas para controlar gasto y tiempo.

- Herramientas y razonamiento: activa funciones externas o modos razonados solo cuando aporten valor.

Antes de lanzar, mide entradas reales con el contador de tokens de DeepSeek y calcula escenarios con la calculadora de coste API. El contexto largo es útil, pero enviar menos información y mejor seleccionada suele mejorar coste, velocidad y precisión.

Pasos para integrar la API en tu producto

- Solicita una clave en la consola y guárdala como variable de entorno; revisa la guía cómo obtener una API key de DeepSeek.

- Define los mensajes de sistema y de usuario, y elige el modelo según latencia y profundidad: V4 Flash para volumen, V4 Pro para razonamiento.

- Estima el consumo con la calculadora de coste de la API y mide tus textos con el contador de tokens.

- Activa streaming, salida JSON o llamadas a herramientas si tu producto lo necesita; añade reintentos y registro de errores.

- Prueba con un conjunto de evaluación propio antes de pasar a producción y aplica controles de privacidad acordes al tipo de datos.

| Parámetro | Para qué sirve | Recomendación |

|---|---|---|

| model | Selecciona V4 Pro, V4 Flash u otro disponible. | Empieza por V4 Flash y sube a V4 Pro cuando lo justifique la tarea. |

| messages | Lleva instrucciones, conversación y contexto. | Sistema + usuario claro; añade ejemplos cuando importe el formato. |

| temperature | Controla la variación del texto generado. | 0.0–0.3 para extracción y soporte; 0.5–0.8 para redacción libre. |

| max_tokens | Limita la longitud de la respuesta. | Ajusta al formato esperado para evitar coste y latencia innecesarios. |

| stream | Recibe la respuesta por partes. | Útil en interfaces de chat con sensación de inmediatez. |

| response_format | Pide salida JSON. | Imprescindible si tu cliente parsea campos estructurados. |

| tools | Permite acciones externas o búsquedas. | Diseña con cuidado los permisos y validaciones. |

Planes y precios

Los precios de DeepSeek deben revisarse siempre en la página actualizada de planes y precios. No publicamos cifras fijas aquí porque pueden cambiar por modelo, región, volumen, caché o política comercial. Lo relevante es entender la estructura: el chat responde a condiciones de uso del servicio, la API suele medirse por tokens y los entornos empresariales pueden requerir acuerdos específicos.

| Modalidad | Cuándo encaja | Qué revisar |

|---|---|---|

| Chat web | Pruebas, estudio, redacción y tareas personales | Límites de uso, modelo activo, disponibilidad y privacidad. |

| API | Productos, automatizaciones y asistentes personalizados | Tokens de entrada y salida, modelo elegido, caché, errores y seguridad de la clave. |

| Empresa | Organizaciones con requisitos de soporte, cumplimiento o integración | SLA, tratamiento de datos, auditoría, soporte y responsabilidades. |

Para estimar coste, calcula cuántos tokens envías, cuántos genera el modelo y cuánto contexto repites. Una arquitectura RAG, que recupera solo fragmentos relevantes de una base documental, puede reducir gasto frente a enviar documentos completos en cada llamada. También conviene presupuestar reintentos, picos de uso y pruebas.

Evita basarte en comparativas antiguas centradas solo en R1 o V3. Desde la llegada de V4, la decisión económica debe considerar calidad, latencia, longitud media de respuesta, tasa de errores, revisión humana y mantenimiento técnico.

DeepSeek para empresas

Evaluación y cumplimiento

DeepSeek puede aportar valor en empresas que trabajan con grandes volúmenes de texto: soporte, documentación técnica, contratos, desarrollo de software, formación, ventas u operaciones. La implantación debe comenzar con un caso acotado, métricas claras y revisión humana. Para una visión aplicada, consulta DeepSeek para empresas españolas.

El punto crítico es el tratamiento de datos. No es lo mismo resumir información pública que procesar datos personales, nóminas, expedientes, historiales médicos o secretos comerciales. Si tu organización opera en la Unión Europea, revisa la guía sobre DeepSeek, RGPD y LOPDGDD, además de tus políticas internas.

Una arquitectura prudente puede incluir anonimización, minimización, pasarelas internas, RAG con fuentes controladas, registros limitados y permisos por rol. Para despliegues con mayores requisitos, los modelos con pesos disponibles pueden evaluarse en entornos propios, siempre revisando licencia, hardware y mantenimiento. Refuerza el proceso con criterios de seguridad y privacidad.

La comparación con otros proveedores debe hacerse con tareas reales. Si estás midiendo alternativas, lee DeepSeek V4 frente a GPT-5.5 y DeepSeek V4 frente a Claude Opus 4.7, pero valida con tus documentos, usuarios, costes y restricciones.

- Empieza con un piloto limitado y datos anonimizados.

- Versiona prompts, pruebas y criterios de aceptación.

- Mantén revisión humana en decisiones de riesgo.

- Define quién responde ante errores, cambios de modelo y uso indebido.

Cuatro fases para evaluar DeepSeek en una empresa

- Selección de casos de uso: dos o tres flujos con métricas claras y un conjunto de evaluación propio con ejemplos reales anonimizados.

- Integración mínima por API: versionar prompts, registrar coste y latencia, y cubrir manejo de errores antes de exponer a usuarios.

- Comparación entre modelos: medir V4 Flash, V4 Pro y el proveedor actual con los mismos casos, y revisar resultados con personas piloto.

- Decisión y despliegue: documentar resultados, riesgos, coste estimado, requisitos legales y plan de despliegue antes de generalizar.

Casos de uso

DeepSeek funciona mejor cuando se aplica a flujos concretos, con entrada clara, salida verificable y una persona o sistema que revise el resultado. No conviene plantearlo como una solución genérica para todo, sino como un asistente especializado por tarea.

- Redacción y resumen: correos, informes, notas de reunión, propuestas, documentación y resúmenes ejecutivos.

- Programación: explicación de errores, pruebas, refactorización, documentación de APIs y revisión de fragmentos de código.

- Soporte: clasificación de tickets, respuestas sugeridas, búsqueda en bases de conocimiento y resúmenes de conversaciones.

- Documentos y OCR: extracción de texto desde imágenes o PDFs, clasificación de formularios y comparación de versiones.

- Educación: explicaciones graduadas, ejercicios, esquemas, corrección de borradores y apoyo al estudio.

- Marketing, ventas y SEO: borradores, FAQs, agrupación de intención de búsqueda y adaptación de mensajes con revisión editorial.

El primer paso razonable es probar una tarea pequeña en el chat, guardar las instrucciones que funcionan y medir si el resultado reduce trabajo sin aumentar riesgo. Si el caso se repite muchas veces, pasa a API, añade evaluación automática y define límites de coste.

En documentos escaneados, usa DeepSeek OCR para extraer texto y luego revisa el resultado antes de analizarlo con V4. El reconocimiento puede fallar en tablas complejas, imágenes borrosas o documentos con mala calidad.

| Caso de uso | Modelo recomendado | Por qué |

|---|---|---|

| Atención al cliente y soporte | V4 Flash | Latencia baja y coste contenido para alto volumen de respuestas. |

| Redacción asistida y resúmenes | V4 Flash | Tareas frecuentes con borradores que después revisa una persona. |

| Programación y revisión técnica | V4 Pro | Razonamiento sobre dependencias y código con contexto largo. |

| Análisis de contratos y documentos | V4 Pro | 1 M tokens para procesar expedientes completos sin trocearlos. |

| Documentación con OCR | V4 Flash + DeepSeek OCR | OCR convierte el PDF y V4 Flash clasifica o resume. |

| Compatibilidad con sistemas existentes | R1 o V3 | Pesos abiertos para despliegues ya validados sobre estos modelos. |

Preguntas frecuentes

¿Es este sitio oficial de DeepSeek?

No. DeepSeek Español es un sitio independiente, informativo y no afiliado a DeepSeek. Publicamos guías, comparativas y herramientas para usuarios hispanohablantes, pero no representamos al proveedor, no gestionamos cuentas oficiales ni intervenimos en soporte, facturación o acceso a sus servicios. Si una decisión depende de precios, condiciones contractuales, disponibilidad regional, límites técnicos o tratamiento de datos, verifica la información en los canales oficiales. Usa este sitio como apoyo editorial y contrasta fechas, capturas y enlaces antes de tomar decisiones operativas o legales.

¿DeepSeek es gratis y cuánto cuesta la API?

El chat puede tener modalidades disponibles para uso directo, según servicio y capacidad. La API suele cobrarse por uso, con coste ligado a tokens de entrada, tokens de salida, modelo y caché. No fijamos cifras aquí porque cambian. Para presupuestos reales consulta planes y precios, mide tus textos y calcula escenarios antes de integrar en producción con margen operativo mensual.

¿Funciona DeepSeek en mi país?

Sí, siempre que el servicio esté disponible y no exista una restricción técnica, contractual o regulatoria aplicable a tu caso. Para uso personal, basta con acceder desde un navegador compatible. Para organizaciones, la cuestión adicional es cumplimiento: dónde se procesan datos, qué proveedores intervienen y qué normas internas aplican. Si trabajas con datos personales, revisa la guía sobre RGPD y LOPDGDD si aplica.

¿Es seguro usar DeepSeek con datos sensibles?

Depende del dato y de la modalidad de uso. No envíes contraseñas, claves API, datos bancarios, información médica identificable, secretos comerciales o expedientes internos a un chat sin evaluación previa. En proyectos profesionales, aplica minimización, anonimización, control de accesos y registros prudentes. Antes de tratar información delicada, revisa seguridad, política de privacidad y las condiciones del proveedor oficial vigentes correspondientes.

¿En qué se diferencia de ChatGPT, Claude o Gemini?

DeepSeek, ChatGPT, Claude y Gemini cubren tareas parecidas: conversación, redacción, programación, análisis de documentos y razonamiento. Las diferencias suelen verse en precio, ventana de contexto, herramientas conectadas, políticas de datos, ecosistema, idiomas, latencia y disponibilidad de modelos abiertos. DeepSeek destaca por la línea V4, con variantes como V4 Pro y V4 Flash, y soporte de hasta 1 millón de tokens; R1 y V3 quedan como antecedentes relevantes. Para elegir, prueba con tus datos, criterios de calidad y restricciones, no solo con rankings públicos.

¿DeepSeek tiene app para teléfono o de escritorio?

Puedes usar DeepSeek desde el navegador en un teléfono, tableta o PC, siempre que el servicio esté disponible en tu región y tu cuenta tenga acceso. También pueden existir aplicaciones oficiales en tiendas de software, según país, sistema operativo y condiciones del proveedor. En escritorio, lo más habitual es la versión web, un acceso directo del navegador o una integración propia mediante API. Descarga solo desde fuentes verificadas, revisa el desarrollador, permisos y reseñas, y evita instalar paquetes, extensiones o clones de procedencia dudosa.

¿Puedo ejecutar DeepSeek de forma local?

Sí, siempre que el modelo tenga pesos disponibles y una licencia compatible con tu caso de uso. R1 y V3 fueron referencias para despliegues propios, investigación y pruebas locales; hoy conviene revisar también la familia V4 si el proveedor publica variantes aptas para instalación. Ejecutar en local mejora el control sobre datos, red y registros, pero exige GPU o aceleradores, memoria suficiente, almacenamiento rápido, monitorización y mantenimiento. Antes de producción, valida calidad, latencia, seguridad, consumo energético, procedencia de los pesos, obligaciones de licencia y un plan de actualizaciones.

¿Qué modelo recomiendas para empezar?

Para empezar, usa DeepSeek V4 Flash si quieres chat rápido, resúmenes, clasificación, borradores o automatizaciones frecuentes. Pasa a V4 Pro cuando la tarea tenga razonamiento complejo, documentos largos, programación con dependencias o mayor riesgo de error. Si mantienes sistemas sobre R1, V3 o V3.2, evalúa migración con pruebas comparativas y cambios controlados. El criterio clave es medir tu caso real.