Si buscas descargar DeepSeek para PC, hay varias formas de usarlo según lo que necesites: desde la versión web, que no requiere instalación, hasta ejecutar modelos en local con herramientas como Ollama, LM Studio o llama.cpp. Elegir bien te ahorra tiempo, evita problemas de hardware y te permite empezar con la opción que mejor encaja con tu ordenador y tu nivel técnico.[1][2]

Resumen rápido

- No existe una única “app oficial para Windows” que debas descargar para usar DeepSeek en PC. La vía más simple es la versión web de DeepSeek, que funciona desde el navegador.[1]

- Si quieres privacidad, trabajo sin conexión o control total, puedes ejecutar modelos abiertos de DeepSeek en local con Ollama, LM Studio o llama.cpp. Los pesos abiertos se distribuyen con licencia MIT.[6]

- Para un uso general sin complicarte, la opción web suele ser suficiente. Para uso local, conviene tener al menos 16 GB de RAM; con 32 GB o una GPU dedicada la experiencia mejora mucho.

- Si vas a integrar DeepSeek en aplicaciones, la API es compatible con el formato de OpenAI y acepta como base

https://api.deepseek.comohttps://api.deepseek.com/v1.[1][3] - DeepSeek V4 Flash y DeepSeek V4 Pro ofrecen hasta 1M tokens de contexto y hasta 384K tokens de salida máxima. V4 Pro añade modos de razonamiento más avanzados, incluido thinking-max.[2][4]

- Si comparas costes de API, en mayo de 2026, V4 Flash cuesta $0,14 por 1M tokens de entrada y $0,28 por 1M de salida; V4 Pro sube a $1,74 y $3,48. DeepSeek V3.2 sigue como opción heredada, pero los alias

deepseek-chatydeepseek-reasonerse deprecian el 24 de julio de 2026.[2][3]

Qué significa realmente descargar DeepSeek para PC

Muchas personas buscan “descargar DeepSeek para PC” pensando en un instalador oficial similar al de un programa de escritorio. En la práctica, DeepSeek puede usarse de tres maneras distintas desde un ordenador: en la web, mediante API o ejecutando modelos abiertos en local. Cada ruta resuelve una necesidad diferente.[1][6]

La opción más sencilla es abrir el chat en el navegador. No instalas nada, no configuras dependencias y puedes empezar en pocos minutos. Esto encaja bien si solo quieres escribir prompts, resumir documentos, traducir textos o pedir ayuda con tareas diarias desde tu ordenador.[1] Si ese es tu caso, te basta con entrar en DeepSeek Chat.

La segunda vía es la API. Aquí no “descargas” DeepSeek como aplicación, sino que conectas tu software a los modelos alojados por DeepSeek. Es útil si quieres integrarlo en un script, una automatización o una herramienta propia. DeepSeek mantiene compatibilidad con clientes que emplean el formato de OpenAI, así que muchas aplicaciones ya existentes pueden adaptarse con pocos cambios.[1][3]

La tercera vía es ejecutar modelos abiertos en tu propio PC. En este caso sí descargas pesos y una herramienta para inferencia local. Esta opción da más privacidad y evita depender de la conexión, aunque exige más memoria, más almacenamiento y algo de configuración inicial.[6] Si quieres comparar capacidades antes de decidir, puedes revisar también DeepSeek V4 Flash y DeepSeek V4 Pro.

Qué opción te conviene: web, Ollama, LM Studio o llama.cpp

La mejor forma de usar DeepSeek en PC depende de tres factores: facilidad de uso, privacidad y potencia de tu equipo. Si no quieres instalar nada, la versión web gana por claridad. Si quieres usar un modelo local con interfaz gráfica, LM Studio suele resultar más cómoda. Si priorizas simplicidad en local, Ollama destaca por su instalación rápida. Si buscas control fino y el mejor ajuste manual, llama.cpp suele ser la alternativa más flexible.

| Opción | Qué necesitas | Ventajas | Limitaciones | Perfil recomendado |

|---|---|---|---|---|

| Web | Navegador y cuenta | Empiezas al momento, cero instalación | Dependes de Internet y del servicio remoto | Uso general |

| API | Clave API y herramienta compatible | Integración en apps y automatizaciones | Requiere algo de configuración | Usuarios técnicos |

| Ollama | Instalador + modelo local | Muy fácil de poner en marcha | Menos control fino que otras opciones | Principiantes en local |

| LM Studio | Aplicación de escritorio + modelo | Interfaz visual, cómoda para probar | Puede consumir bastantes recursos | Quien prefiere interfaz gráfica |

| llama.cpp | Binarios o compilación + modelo | Control detallado, muy configurable | Más técnico | Usuarios avanzados |

Si tu objetivo es probar DeepSeek hoy mismo, empieza por la web. Si en unos días descubres que necesitas trabajar con datos sensibles o usarlo sin conexión, da el salto a una instalación local. Ese orden evita dedicar tiempo a una configuración que quizá no necesitas.

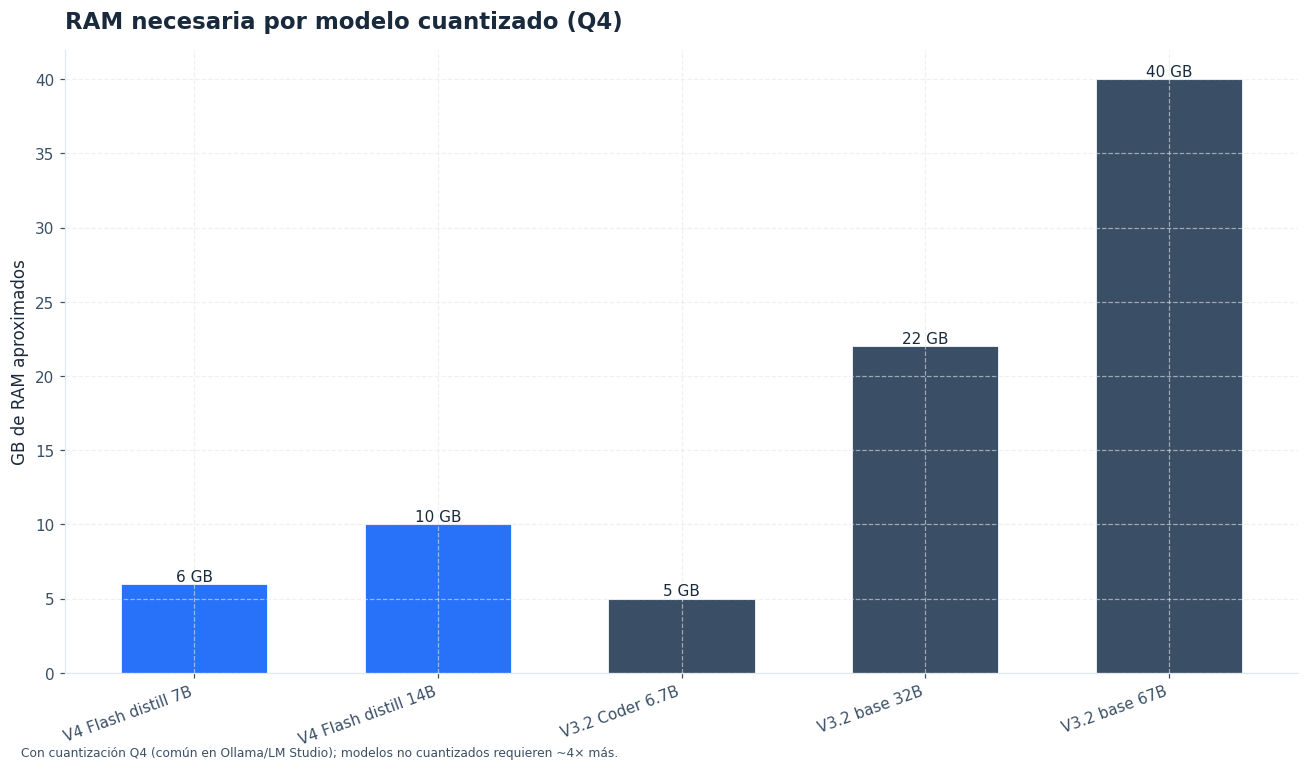

Requisitos de hardware para usar DeepSeek en local

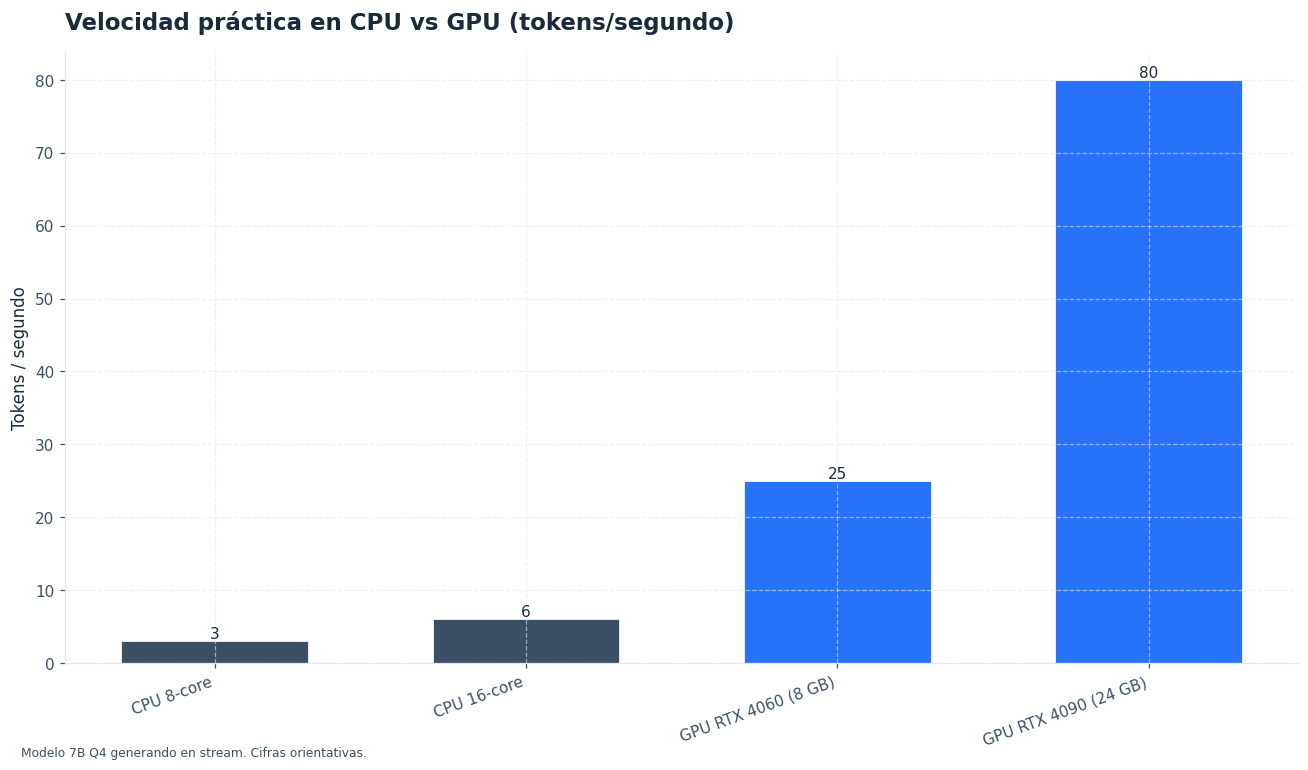

El punto clave no es solo el procesador. Para ejecutar modelos locales, la memoria manda. Cuanta más RAM tengas, más margen tendrás para cargar modelos cuantizados sin que el sistema se vuelva lento. En un PC básico, 16 GB de RAM pueden servir para pruebas ligeras. Con 32 GB, la experiencia suele ser bastante más estable. Una GPU con suficiente VRAM acelera la generación, pero no siempre es obligatoria si usas cuantizaciones adecuadas.

- Mínimo práctico: 16 GB de RAM, SSD y CPU moderna.

- Recomendado para ir cómodo: 32 GB de RAM y SSD rápido.

- Si tienes GPU dedicada: mejor tiempo de respuesta y más margen para modelos mayores.

- Espacio en disco: reserva decenas de GB si vas a probar varios modelos o cuantizaciones.

También conviene ajustar expectativas. Un modelo local en un portátil modesto puede responder bien para tareas sencillas, pero no tendrá la misma rapidez ni el mismo contexto que un modelo remoto de última generación servido desde la nube. Por ejemplo, DeepSeek V4 Flash y DeepSeek V4 Pro en API llegan a 1M tokens de contexto, con salida máxima de 384K tokens, algo muy por encima de lo habitual en configuraciones locales domésticas.[2]

Si dudas entre usar nube o local, una regla simple funciona bien: para conversación general y documentos largos, la nube suele ser más cómoda; para pruebas privadas, automatizaciones internas o aprendizaje técnico, local tiene más sentido.

Cómo empezar paso a paso en tu ordenador

Estas son las rutas más útiles para empezar sin perderte.

Opción 1: usar DeepSeek en la web

- Abre el chat de DeepSeek en tu navegador.

- Inicia sesión o crea tu cuenta.

- Escribe una tarea concreta: por ejemplo, resumir un PDF, redactar un correo electrónico o generar ideas.

- Si necesitas comparar modelos o límites, revisa la página de precios y las fichas de modelos.

Esta vía es la más recomendable si no quieres tocar terminal, descargar pesos ni revisar compatibilidades.

Opción 2: usar DeepSeek desde la API

- Crea una clave API en la plataforma de DeepSeek.

- Configura tu cliente con la base

https://api.deepseek.como, por compatibilidad,https://api.deepseek.com/v1.[1][3] - Elige el modelo:

deepseek-v4-flashpara coste bajo y rapidez, odeepseek-v4-prosi priorizas calidad y razonamiento.[2] - Haz una primera prueba con una petición sencilla.

curl https://api.deepseek.com/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer TU_API_KEY" \

-d '{

"model": "deepseek-v4-flash",

"messages": [

{"role": "system", "content": "Responde en español neutro."},

{"role": "user", "content": "Dame tres pasos para organizar archivos en Windows."}

]

}'Si quieres profundizar en parámetros, compatibilidad o ejemplos, consulta la documentación de la API. DeepSeek indica compatibilidad con el formato de OpenAI y Anthropic en su documentación oficial.[1]

Opción 3: ejecutar un modelo de DeepSeek en local

- Elige una herramienta: Ollama si quieres facilidad, LM Studio si prefieres interfaz gráfica, o llama.cpp si necesitas control.

- Descarga un modelo abierto de DeepSeek desde un repositorio fiable.

- Verifica el tamaño del archivo y la cuantización antes de cargarlo.

- Prueba primero con un prompt corto para comprobar memoria, temperatura y velocidad.

- Ajusta el contexto y el número de capas en GPU según tu equipo.

Los pesos abiertos de DeepSeek se publican con licencia MIT, lo que facilita su uso y experimentación dentro de los términos aplicables.[6] Aun así, conviene revisar siempre la fuente exacta del modelo que descargas y su documentación asociada.

Qué modelo elegir si usas la nube en lugar de instalarlo

Si tu meta no es ejecutar nada en local, sino usar DeepSeek desde el navegador o la API, la decisión principal está entre DeepSeek V4 Flash y DeepSeek V4 Pro. Ambos comparten 1M tokens de contexto y hasta 384K tokens de salida. La diferencia está en el coste y en la capacidad de razonamiento.[2]

| Modelo | Entrada 1M tokens | Entrada con caché | Salida 1M tokens | Perfil |

|---|---|---|---|---|

| DeepSeek V4 Flash | $0,14 | $0,028 | $0,28 | Uso general, coste bajo, respuestas rápidas |

| DeepSeek V4 Pro | $1,74 | $0,87 | $3,48 | Tareas complejas, más razonamiento |

| DeepSeek V3.2 (heredado) | $0,28 | — | $0,42 | Compatibilidad y flujos heredados |

Además, DeepSeek V4 Flash incluye modos con y sin razonamiento, mientras que DeepSeek V4 Pro añade tres modos de razonamiento y reserva thinking-max para la variante más potente.[4] Si vas a trabajar con análisis complejos, instrucciones largas o tareas donde la calidad pesa más que el coste, Pro es la opción lógica. Para la mayoría de tareas cotidianas, Flash suele ser suficiente.

En cuanto a compatibilidad heredada, los alias deepseek-chat y deepseek-reasoner siguen disponibles, pero DeepSeek ha indicado su deprecación para el 24 de julio de 2026. Si empiezas ahora un proyecto nuevo, conviene usar directamente deepseek-v4-flash o deepseek-v4-pro.[1][3]

Errores frecuentes al intentar descargar DeepSeek para PC

- Buscar un instalador oficial que no necesitas. Si solo quieres usar el chat, el navegador basta.

- Descargar un modelo demasiado grande para tu RAM. Eso provoca lentitud extrema o cierres.

- Confundir la API con una app local. La API ejecuta el modelo en la infraestructura de DeepSeek, no en tu PC.[1]

- Empezar con una herramienta demasiado técnica. Si eres principiante, LM Studio u Ollama suelen dar menos fricción que llama.cpp.

- Usar alias heredados en proyectos nuevos. Con fecha de deprecación ya publicada, es mejor partir de V4 Flash o V4 Pro.[3]

Preguntas frecuentes

¿Se puede descargar DeepSeek para PC gratis?

Sí, pero depende de qué entiendas por “DeepSeek”. Usar la versión web puede requerir solo una cuenta, mientras que ejecutar modelos abiertos en local implica descargar pesos disponibles en repositorios abiertos. Si usas la API, el consumo se factura por tokens según el modelo elegido.[2][6]

¿Hace falta una tarjeta gráfica potente para usar DeepSeek en local?

No siempre. Puedes ejecutar modelos cuantizados solo con CPU y RAM suficiente, aunque la velocidad será menor. Una GPU ayuda mucho, sobre todo si quieres respuestas más rápidas o modelos más grandes.

¿Qué es mejor para empezar: Ollama o LM Studio?

Si prefieres una interfaz visual, LM Studio suele resultar más cómoda. Si te vale una instalación rápida con pocos pasos y no te importa usar terminal, Ollama suele ser más directa. Ninguna de las dos es universalmente mejor; cambia según tu forma de trabajar.

¿La API de DeepSeek funciona con herramientas compatibles con OpenAI?

Sí. DeepSeek documenta compatibilidad con el formato de OpenAI y permite usar la base https://api.deepseek.com/v1 por motivos de compatibilidad. El sufijo /v1 no indica una versión de modelo concreta.[1][3]

¿Sigue mereciendo la pena usar DeepSeek V3.2?

Puede tener sentido si mantienes flujos heredados o compatibilidad con integraciones antiguas. Para proyectos nuevos, DeepSeek V4 Flash o DeepSeek V4 Pro son opciones más razonables. Además, los alias deepseek-chat y deepseek-reasoner tienen deprecación anunciada para el 24 de julio de 2026.[1][3]

Recursos relacionados

- Qué es DeepSeek y cómo encaja en el ecosistema actual

- Precios de DeepSeek y comparación por modelos

- Guía de la API de DeepSeek

- Ficha de DeepSeek V4 Flash

- Ficha de DeepSeek V4 Pro

Conclusión

Si tu objetivo es descargar DeepSeek para PC, la decisión correcta no empieza por un instalador, sino por el uso que le vas a dar. Para chatear o resolver tareas diarias, la versión web es la vía más rápida. Para integrar DeepSeek en herramientas, la API compatible con OpenAI simplifica mucho el trabajo. Y si quieres privacidad o uso sin conexión, una instalación local con Ollama, LM Studio o llama.cpp tiene sentido. El mejor siguiente paso es elegir una sola ruta, probarla hoy y ajustar después según el rendimiento real de tu equipo.